1/9实验四、RBF神经网络一、实验目的通过计算机编程实现并验证RBF神经网络的曲线拟合及模式分类能力

二、实验内容1)用Matlab实现RBF神经网络,并对给定的曲线样本集实现拟合;2)通过改变实验参数,观察和分析影响RBF神经网络的结果与收敛速度的因素;三、实验原理、方法和手段RBF网络能够逼近任意的非线性函数,可以处理系统内的难以解析的规律性,具有良好的泛化能力,并有很快的学习收敛速度,已成功应用于非线性函数逼近、时间序列分析、数据分类、模式识别、信息处理、图像处理、系统建模、控制和故障诊断等

简单说明一下为什么RBF网络学习收敛得比较快

当网络的一个或多个可调参数(权值或阈值)对任何一个输出都有影响时,这样的网络称为全局逼近网络

由于对于每次输入,网络上的每一个权值都要调整,从而导致全局逼近网络的学习速度很慢

BP网络就是一个典型的例子

如果对于输入空间的某个局部区域只有少数几个连接权值影响输出,则该网络称为局部逼近网络

常见的局部逼近网络有RBF网络、小脑模型(CMAC)网络、B样条网络等

径向基函数解决插值问题完全内插法要求插值函数经过每个样本点,即

样本点总共有P个

RBF的方法是要选择P个基函数,每个基函数对应一个训练数据,各基函数形式为,由于距离是径向同性的,因此称为径向基函数

||X-Xp||表示差向量的模,或者叫2范数

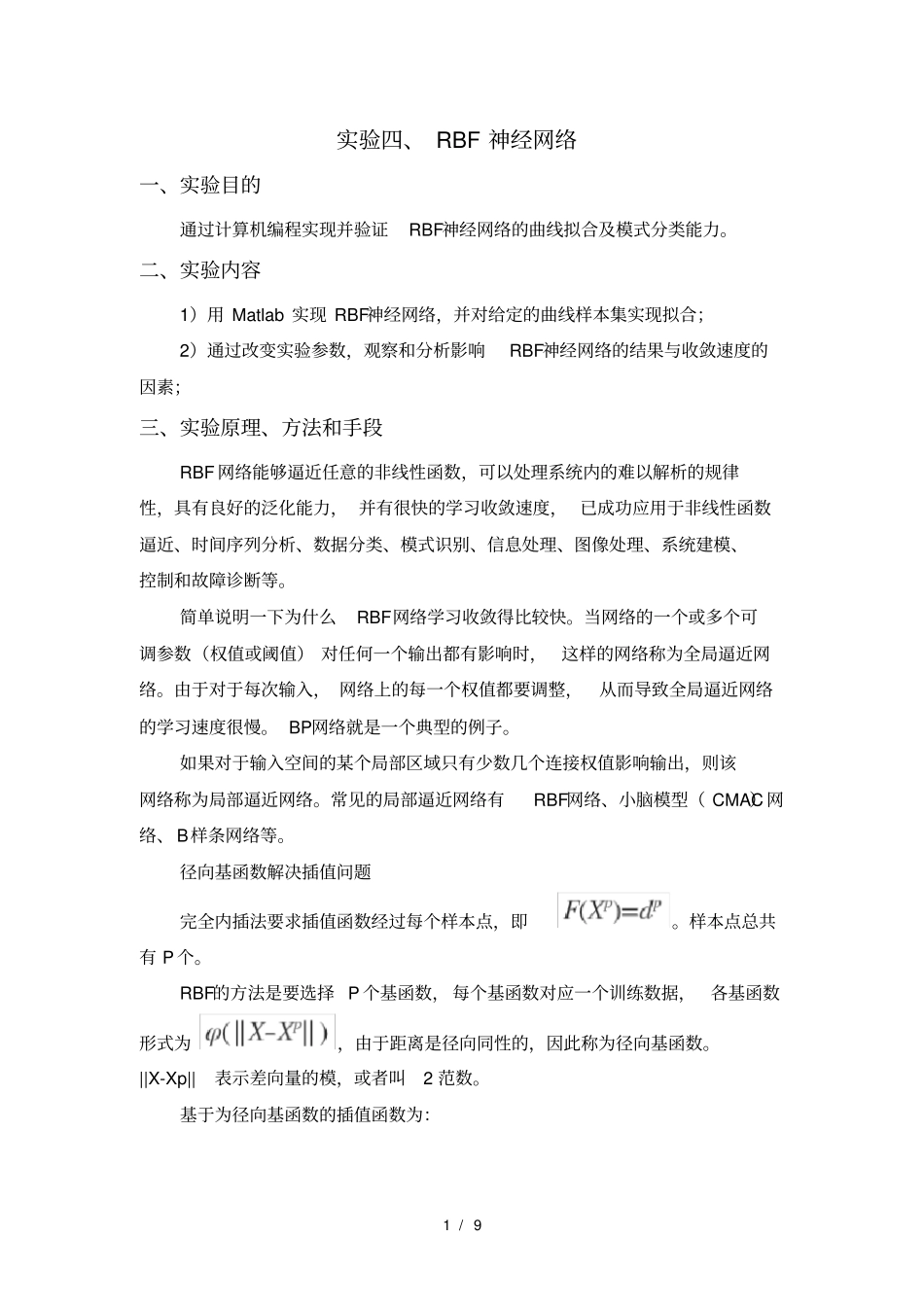

基于为径向基函数的插值函数为:2/9输入X是个m维的向量,样本容量为P,P>m

可以看到输入数据点Xp是径向基函数φp的中心

隐藏层的作用是把向量从低维m映射到高维P,低维线性不可分的情况到高维就线性可分了

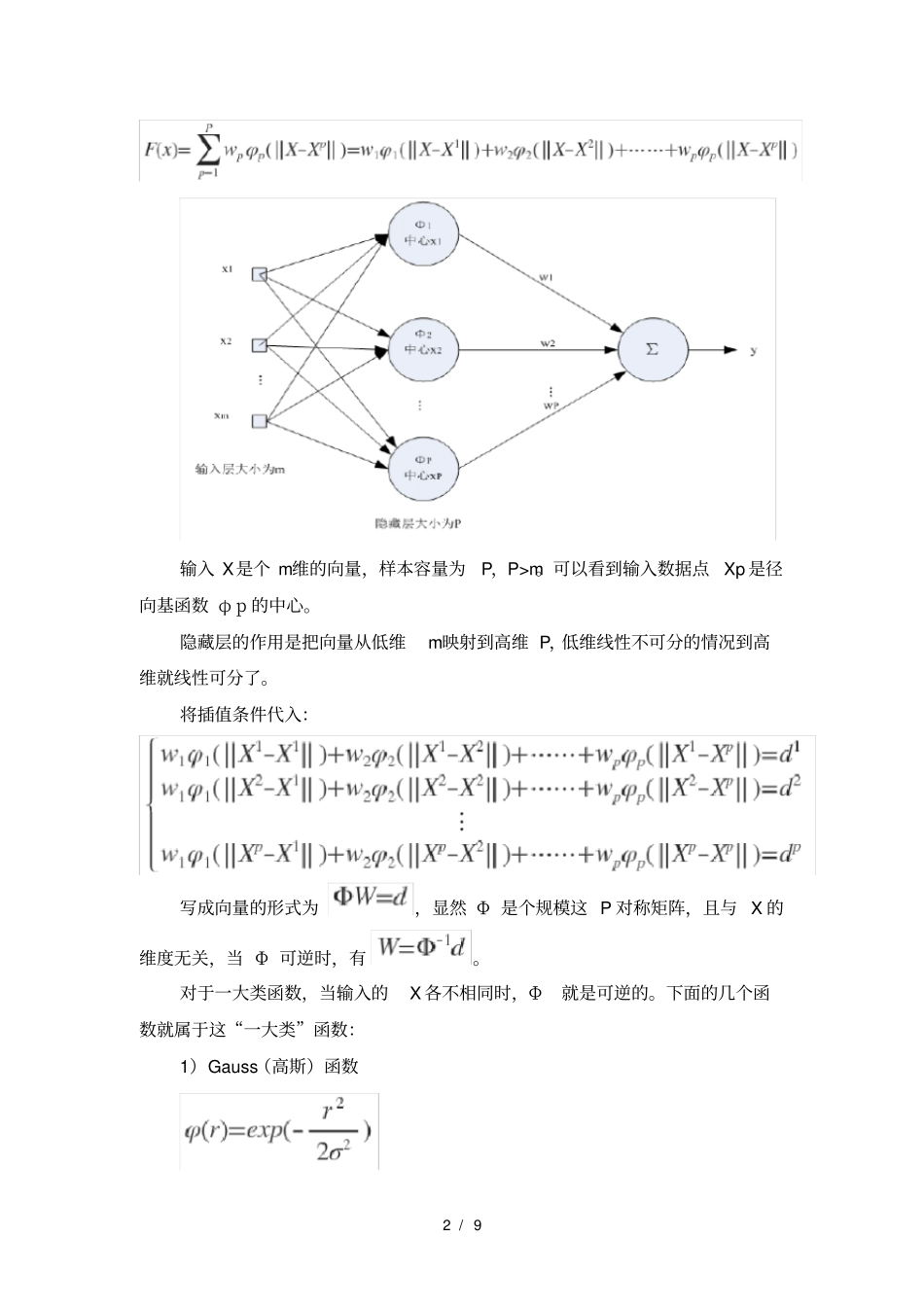

将插值条件代入:写成向量的形式为,显然Φ是个规模这P对称矩阵,且与X的维度无关,当Φ可逆时,有

对于一大类函数,当输入的X各不相同时,Φ就是可逆的

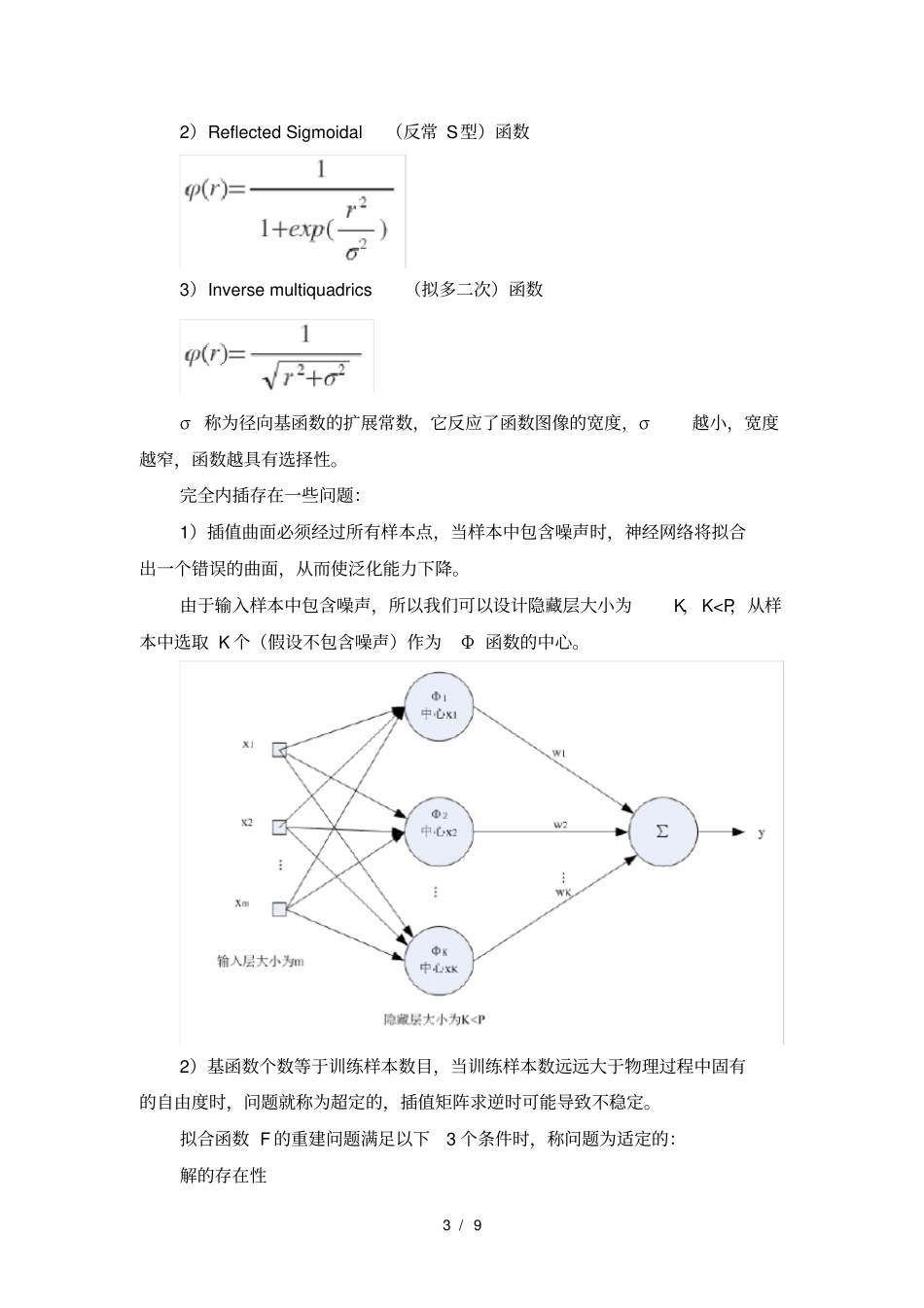

下面的几个函数就属于这“一大类”函数:1)Gauss(高斯)函数3/92)Refle