数据挖掘第二次作业 1

(a) Find all frequent itemsets using Apriori and FP-growth, respectively, by treating each transaction ID as a market basket

Compare the efficiency of the two mining processes

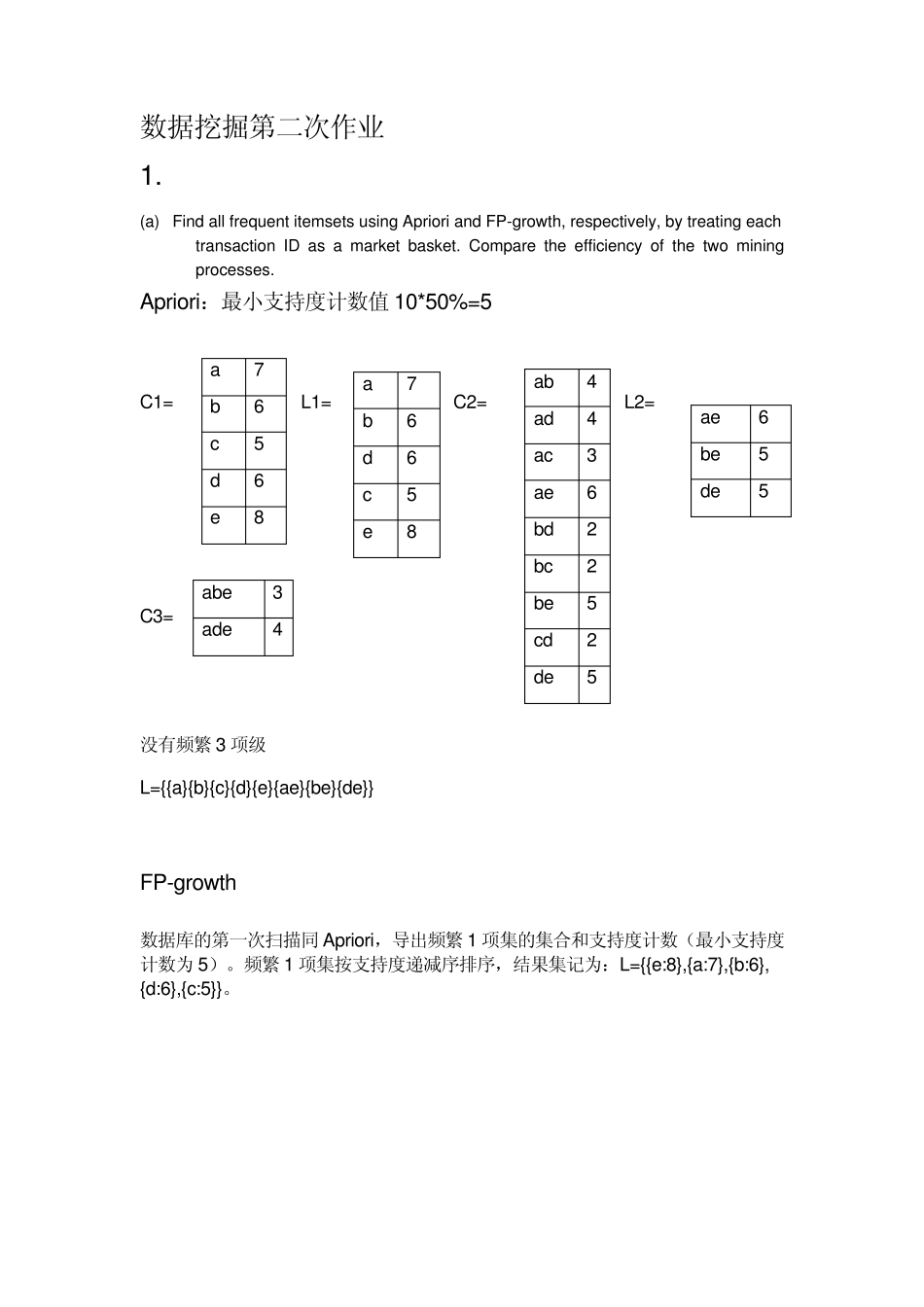

Apriori:最小支持度计数值10*50%=5 C1= L1= C2= L2= C3= 没有频繁3 项级 L={{a}{b}{c}{d}{e}{ae}{be}{de}} FP-growth 数据库的第一次扫描同Apriori,导出频繁1 项集的集合和支持度计数(最小支持度计数为5)

频繁1 项集按支持度递减序排序,结果集记为:L={{e:8},{a:7},{b:6}, {d:6},{c:5}}

a 7 b 6 c 5 d 6 e 8 ab 4 ad 4 ac 3 ae 6 bd 2 bc 2 be 5 cd 2 de 5 ae 6 be 5 de 5 a 7 b 6 d 6 c 5 e 8 abe 3 ade 4 构造FP 树如下: 从底层开始构建条件模式基挖掘条件FP树从而找出频繁项集 项 条件模式基 条件FP树 产生的频繁模式 c {{ead:1}{eab:1}{eb:1}{d:1}{ab:1}} {} d {{ea:3}{eab:1}{eb:2}} {ed:5}{ad:4}{ead:4} b {{ea:3}{e:2}{a:1}} , {eb:5}{ab:4} a {{e:6}} {ea:6} L={{a}{b}{c}{d}{e}{ae}{be}{de}}; Apriori 与FP-growth 的效率比较: Apriori 挖掘全部频繁项集时需要产生候选项集,而且需要多次重复地扫描数据库,