线性鉴别分析法 线性鉴别分析(Linear Discriminant Analysis, LDA),有时也称Fisher线性判别(Fisher Linear Discriminant ,FLD), 这种算法是Ronald Fisher 于 1936年发明的,是模式识别的经典算法[i]

在1996 年由Belhumeur 引入模式识别和人工智能领域的

性鉴别分析的基本思想是将高维的模式样本投影到最佳鉴别矢量空间,以达到抽取分类信息和压缩特征空间维数的效果,投影后保证模式样本在新的子空间有最大的类间距离和最小的类内距离,即模式在该空间中有最佳的可分离性

因此,它是一种有效的特征抽取方法

使用这种方法能够使投影后模式样本的类间散布矩阵最大,并且同时类内散布矩阵最小

就是说,它能够保证投影后模式样本在新的空间中有最小的类内距离和最大的类间距离,即模式在该空间中有最佳的可分离性

1 Fisher线性判别准则 假设有一组属于两个类的n 个d 维样本x1 ,...,xn ,其中前n1 个样本属于类1 ,后面n2 个样本属于类2 ,均服从同协方差矩阵的高斯分布

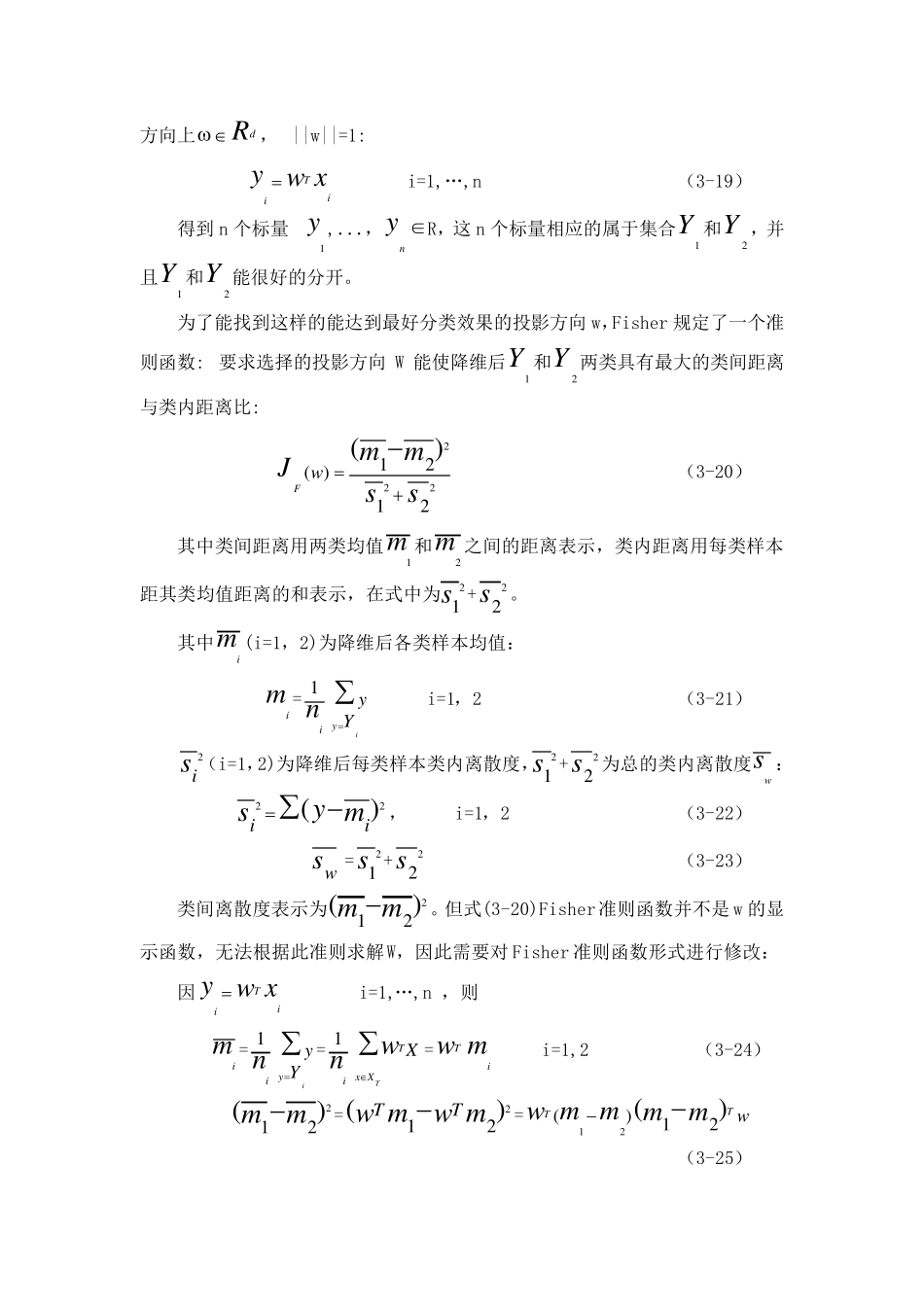

各类样本均值向量mi (i=1,2)如式(3-15): mi =ni1 tXxX i=1,2 (3-15) 样本类内离散度矩阵si 和总的类内离散度矩阵sw 如式(3-16)、式(3-17): TiXxiiimxmxmSt)()( i=1,2 (3-16) sw =s1 +s2 (3-17) t 样本类间离散度矩阵sb 如式(3-18): TbmmmmS))((2121 (3-18) 现寻找一最佳超平面将两类分开,则只需将所有样本投影到此超平面的法线方向上 Rd ,||w||=1: xwyiTi i=1,…,n (3-19) 得到 n 个标量 y1,...,yn∈R,这 n 个标量相应的属于集