学习神经网络的好助手,可以仿照其中的代码,只需修改个别参数便可以轻易实现自己需要完成的任务

p=p1';t=t1'; [pn,minp,maxp,tn,mint,maxt]=premnmx(p,t); %原始数据归一化 net=newff(minmax(pn),[5,1],{'tansig','purelin'},'traingdx'); %设置网络,建立相应的BP 网络,minmax(pn)找到pn 矩阵的最大最小值 net

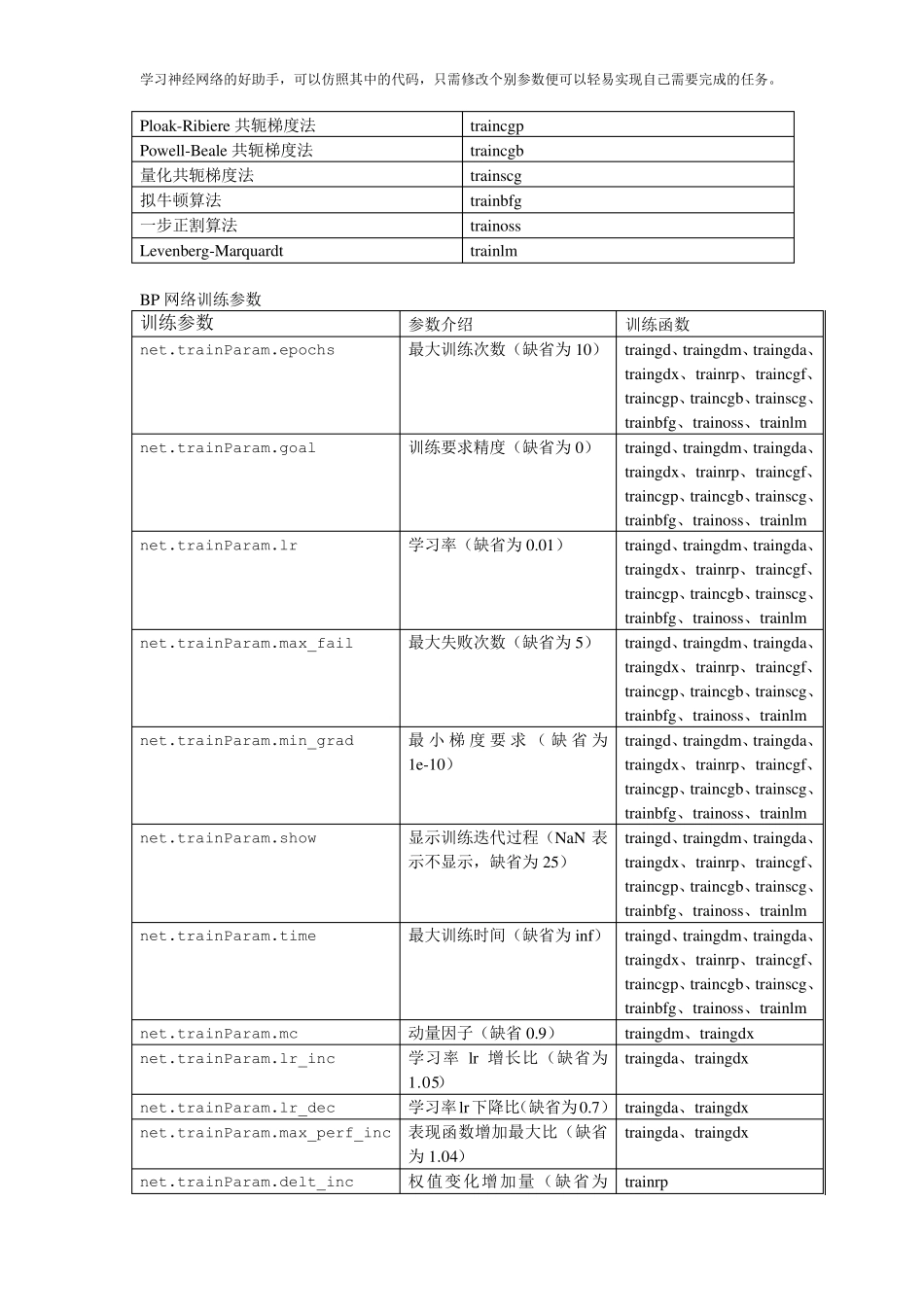

trainParam

show=2000; % 训练网络 net

trainParam

01; net

trainParam

epochs=100000; net

trainParam

goal=1e-5; [net,tr]=train(net ,pn,tn); %调用TRAINGDM 算法训练BP网络 pnew=pnew1'; pnewn=tramnmx(pnew,minp,maxp); anewn=sim(net,pnewn); %对BP 网络进行仿真 anew=postmnmx(anewn,mint,maxt); %还原数据 y=anew'; 1、BP 网络构建 (1)生成BP 网络 (,[ 1 2

],{1 2

},,,)netnew ff PR S SSNlTF TFTFNlBTF BLF PF PR :由 R 维的输入样本最小最大值构成的2R维矩阵

]S SSNl :各层的神经元个数

}TF TFTFNl :各层的神经元传递函数

BTF :训练用函数的名称

(2)网络训练 [,, ,,,] (, , ,,,,)net tr Y E Pf Aftrain net P T Pi Ai