后验支持向量机学习报告1后验支持向量机支持向量机(SVM)是在由Vapnik等人发展的统计学习理论基础上发展起来的一类学习算法,通过对线性可分训练集按类间最大间隔设计分类器的方法来达到较好的推广能力

对于非线性可分的数据集引入了松弛变量来控制样本的误分率构造线性分类器,利用核方法推广线性分类器为非线性分类器

SVM能够较好的泛化能力,在许多问题上表现得很好,于是对SVM的研究受到人们很大的关注,同时SVM的使用也越来越广泛,但SVM仅能给出分类结果,而不能给出确切的各类的概率,而在很多应用场合中,人们不仅关注分类的结果,更关注分为各类的概率

如银行的信用欺诈检测,银行不仅想知道哪些人存在欺诈的可能,更希望能知道每个人欺诈的概率,这样有助于银行做出更好地决策

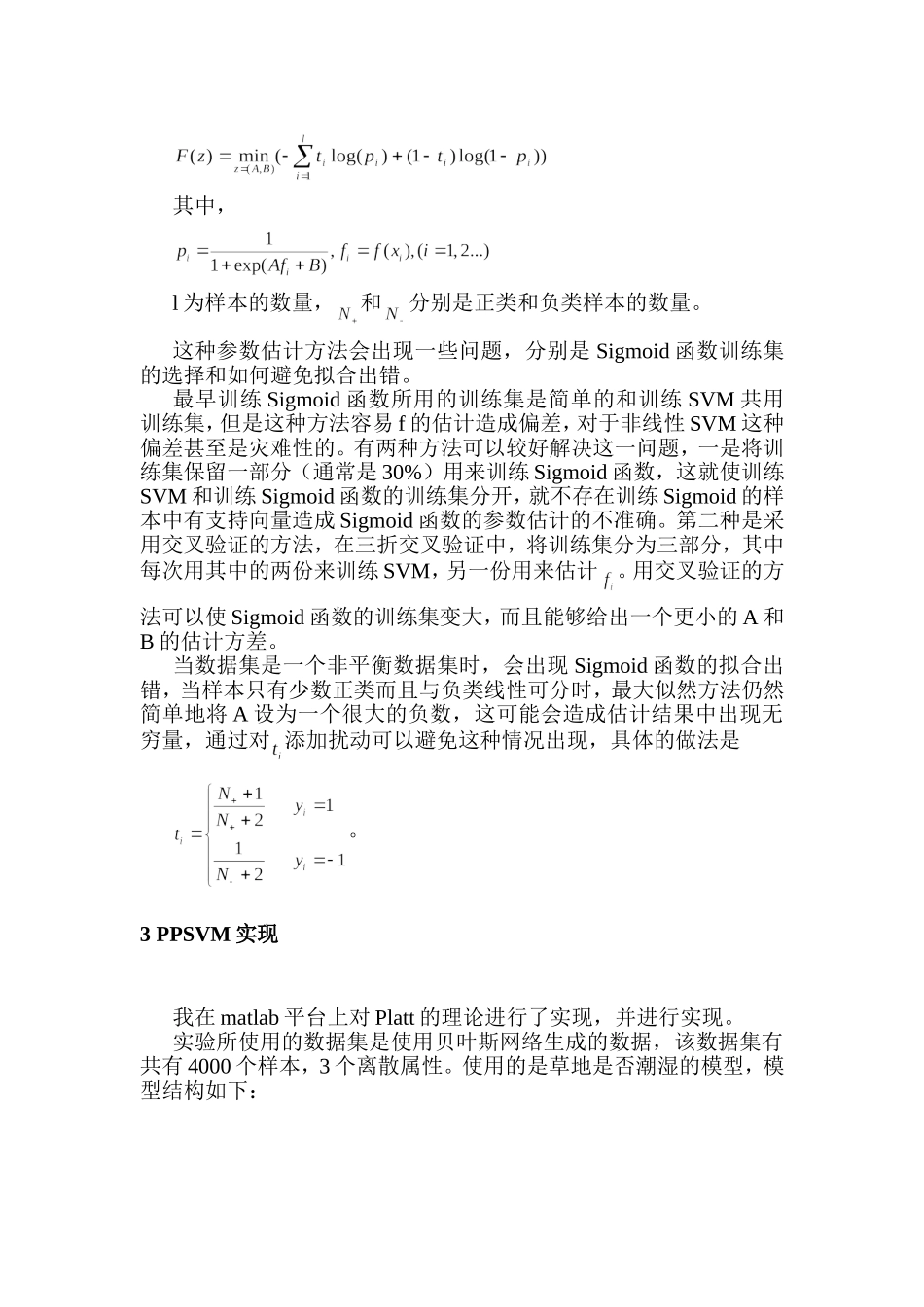

贝叶斯分类器虽然能提供各类的后验概率,但贝叶斯分类器需要预先知道类条件概率密度,通常在实际问题中这是无法获取的

Vapnik提出一种将SVM的离散输出映射为概率的方法,Wahha研究再生核Hilbert空间的表示定理,应用到统计学习理论和SVM中

Platt等提出一种将支持向量机决策函数的输出映射为类后验概率的算法(PPSVM),这是本次学习的主要内容

2后验支持向量机PPSVMPlatt提出PPSVM,主要思想是用拟合一个后验概率的参数模型,将标准SVM的输出结果映射为后验概率

设SVM的输入为,其中,误差函数:,Platt的主要工作就是找到Sigmoid函数用于近似支持向量机的后验概率,Sigmoid函数转换形式如下:其中,f为标准SVM的输出结果,表示在输出值f的条件下分类正确的概率

A和B是需要估计的参数值,其优化策略可以通过解最大似然问题来解决:其中,l为样本的数量,和分别是正类和负类样本的数量

这种参数估计方法会出现一些问题,分别是Sigmoid函数训练集的选择和如何避免拟合出错

最早训练Sigmoid函数所