中国地质大学课程报告课程名称:数据挖掘指导老师:蒋良孝学生学号:20131003701学生班级:086131学生姓名:刘卫1对KNN算法的优化k-近邻算法概述k-近邻(kNearestNeighbors)算法采用测量不同特征之间的距离方法进行分类

它的工作原理是:存在一个样本数据集合,并且样本集中每个数据都存在标签,即我们知道样本每一数据与所属分类的对应关系

输入没有标签的新数据后,将新数据的每个特征与样本集中数据对应的特征进行比较,然后算法提取样本集中特征最相似数据的分类标签

一般来说,我们只选择样本数据集中前k个最相似的数据,这就是k-近邻算法中k的出处,通常k是不大于20的奇数

最后,选择k个最相似数据中出现次数最多的分类,作为新数据的分类

k-近邻算法的优点是精度高,对异常值不敏感,无数据输入假定;缺点是计算复杂度高、空间复杂度高

适用于数值和标称型数据

使用k-近邻算法将每组数据划分到某个类中,其伪代码如下:对未知类别属性的数据集中的每个点依次执行以下操作:计算已知类别数据集中的点与当前点之间的距离;按照距离递增交序排序;选取与当前点距离最小的k个点;确定前k个点所在类别的出现频率;返回前k个点出现频率最高的类别作为当前点的预测分类

提出问题:1

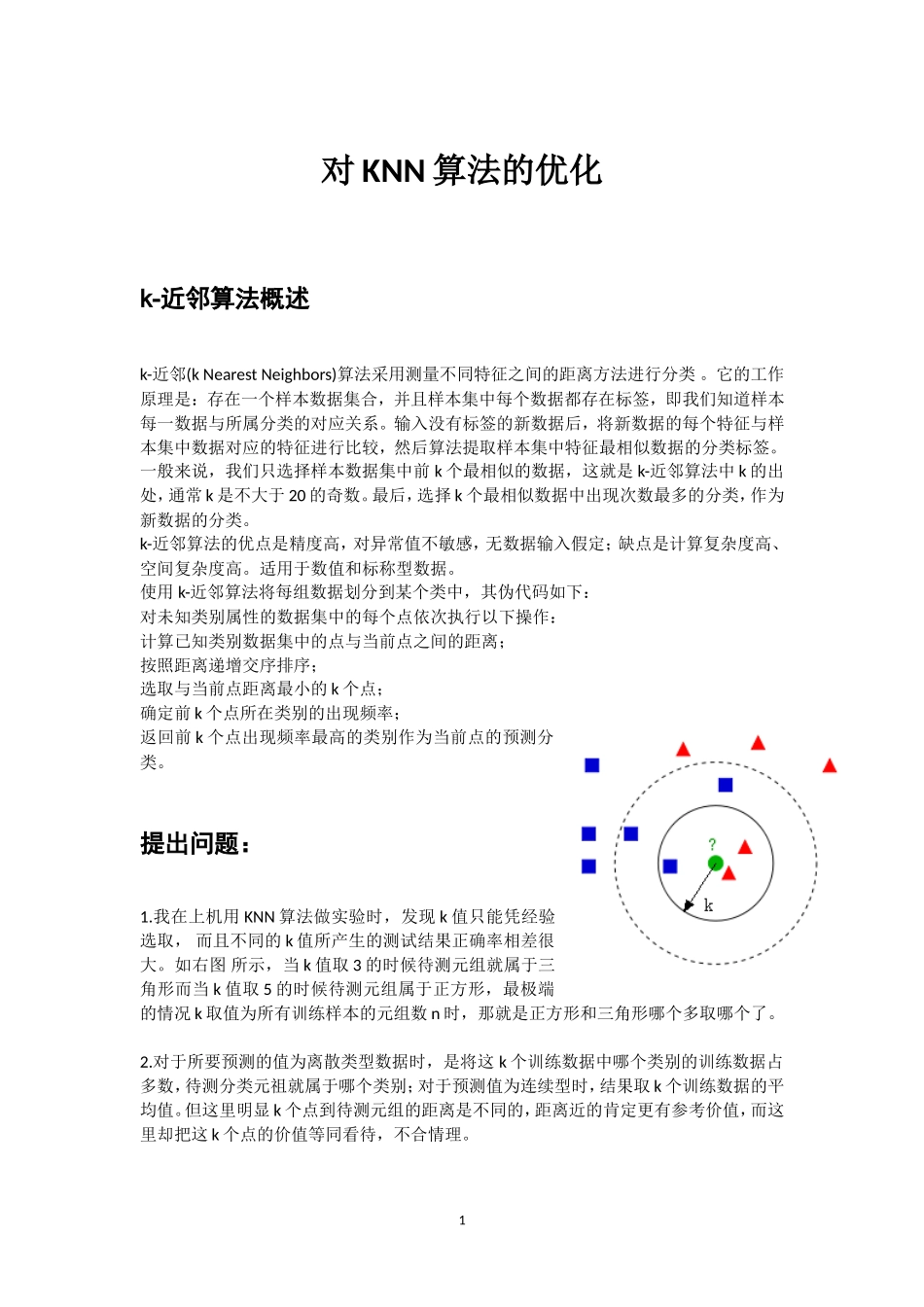

我在上机用KNN算法做实验时,发现k值只能凭经验选取,而且不同的k值所产生的测试结果正确率相差很大

如右图所示,当k值取3的时候待测元组就属于三角形而当k值取5的时候待测元组属于正方形,最极端的情况k取值为所有训练样本的元组数n时,那就是正方形和三角形哪个多取哪个了

对于所要预测的值为离散类型数据时,是将这k个训练数据中哪个类别的训练数据占多数,待测分类元祖就属于哪个类别;对于预测值为连续型时,结果取k个训练数据的平均值

但这里明显k个点到待测元组的距离是不同的,距离近的肯定更有参考价值,而这里却把这k个点的价值等同