增强学习ReinforcementLearning经典算法梳理1:policyandvalueiteration前言就目前来看,深度增强学习(DeepReinforcementLearning)中的很多方法都是基于以前的增强学习算法,将其中的valuefunction价值函数或者Policyfunction策略函数用深度神经网络替代而实现

因此,本文尝试总结增强学习中的经典算法

本文主要参考:1ReinforcementLearning:AnIntroduction;2ReinforcementLearningCoursebyDavidSilver1预备知识对增强学习有所理解,知道MDP,Bellman方程详细可见:DeepReinforcementLearning基础知识(DQN方面)很多算法都是基于求解Bellman方程而形成:ValueIterationPolicyIterationQ-LearningSARSA2PolicyIteration策略迭代PolicyIteration的目的是通过迭代计算valuefunction价值函数的方式来使policy收敛到最优

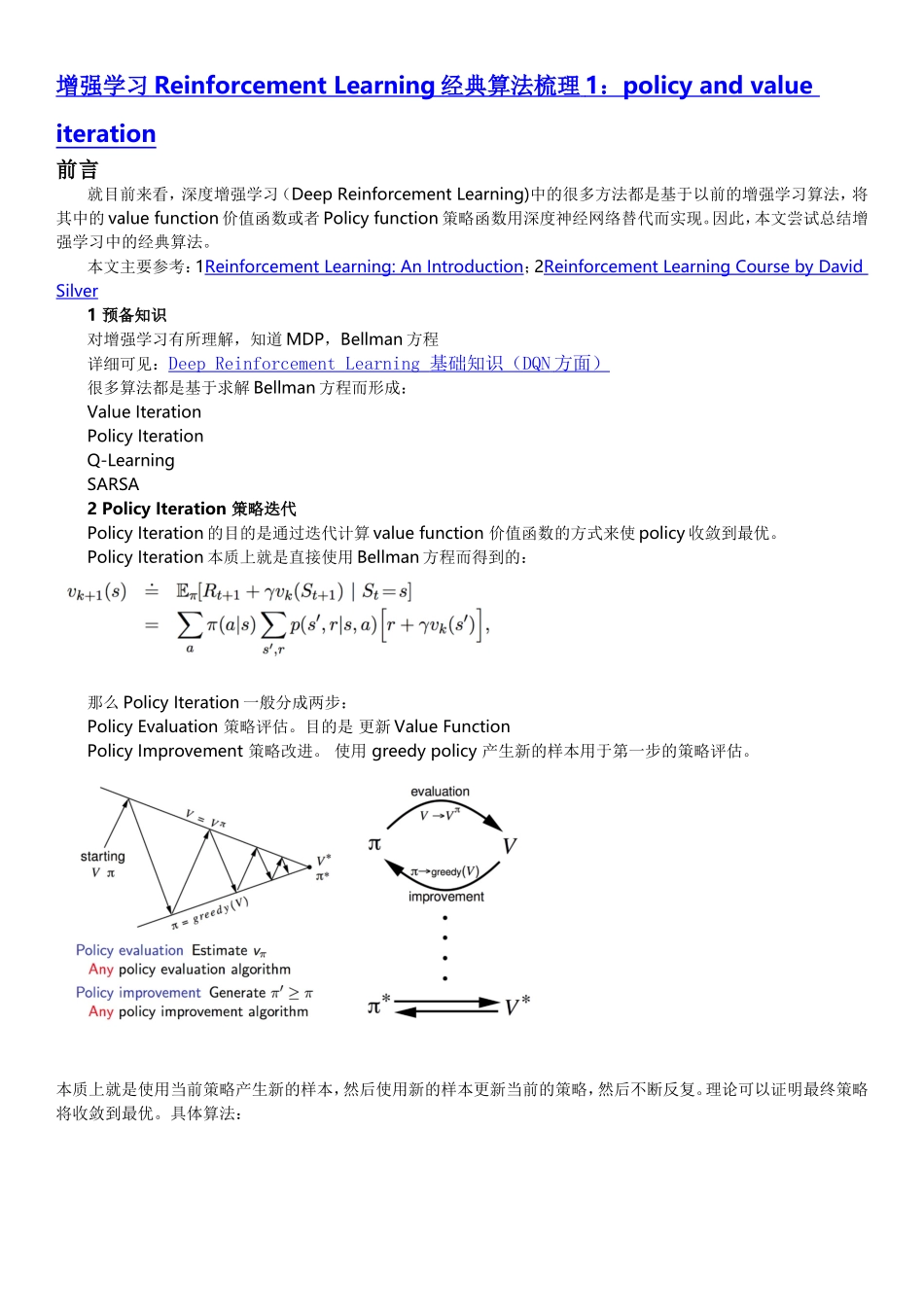

PolicyIteration本质上就是直接使用Bellman方程而得到的:那么PolicyIteration一般分成两步:PolicyEvaluation策略评估

目的是更新ValueFunctionPolicyImprovement策略改进

使用greedypolicy产生新的样本用于第一步的策略评估

本质上就是使用当前策略产生新的样本,然后使用新的样本更新当前的策略,然后不断反复

理论可以证明最终策略将收敛到最优

具体算法:那么这里要注意的是policyevaluation部分

这里的迭代很重要的一点是需要知道state状态转移概率p

也就是说依赖于model模型

而且按照算法要反复迭代直到收敛为止