分类1・1K-最近邻算法(K-NN)存在一个样本数据集合,也称作训练样本集,并且样本集中的每个数据都存在标签,即我们知道样本集中每一数据与所述分类的对应关系

输入没有标签的新数据后,将新数据的每个特征与样本集中数据对应的特征进行比较,然后算法提取样本集中特征最相似数据(最近邻)的分类标签

一般来说,选择样本数据集中的前 k 个相似的数据

最后选择 k 个最相似数据中出现次数最多的分类,作为新数据的分类

伪代码:对未知类别属性的数据集中的每个点依次执行以下操作:(1)计算已知类别数据集中的点与当前点之间的距离;(2)按照距离递增依次排序;(3)选取与当前点距离最小的 k 个点;(4)确定前 k 个点所在类别的出现频率;(5)返回前 k 个点出现频率最高的类别作为当前点的预测分类

如图,平面有 3 个样本集将空间分为三类,输入新的数据点,使用欧拉距离来计算当前点与已知类别数据集中的点之间的距离,并选择 K=5 作为参数

在距离最近的 5 个特征点中,有 4 个点属于类别 W],1 个点属于类别 w2,因此分类器将输入点划分至 w1类

1・2 决策树分类决策树模型是一种描述对实例进行分类的树形结构

决策树由结点和有向边组成

结点有两种类型:内部节点和叶节点,内部节点表示一个特征或属性,叶节点表示一个类

分类的时候,从根节点开始,对实例的某一个特征进行测试,根据测试结果,将实例分配到其子结点;此时,每一个子结点对应着该特征的一个取值

如此递归向下移动,直至达到叶结点,最后将实例分配到叶结点的类中

如下图所示流程图就是一个决策树模型

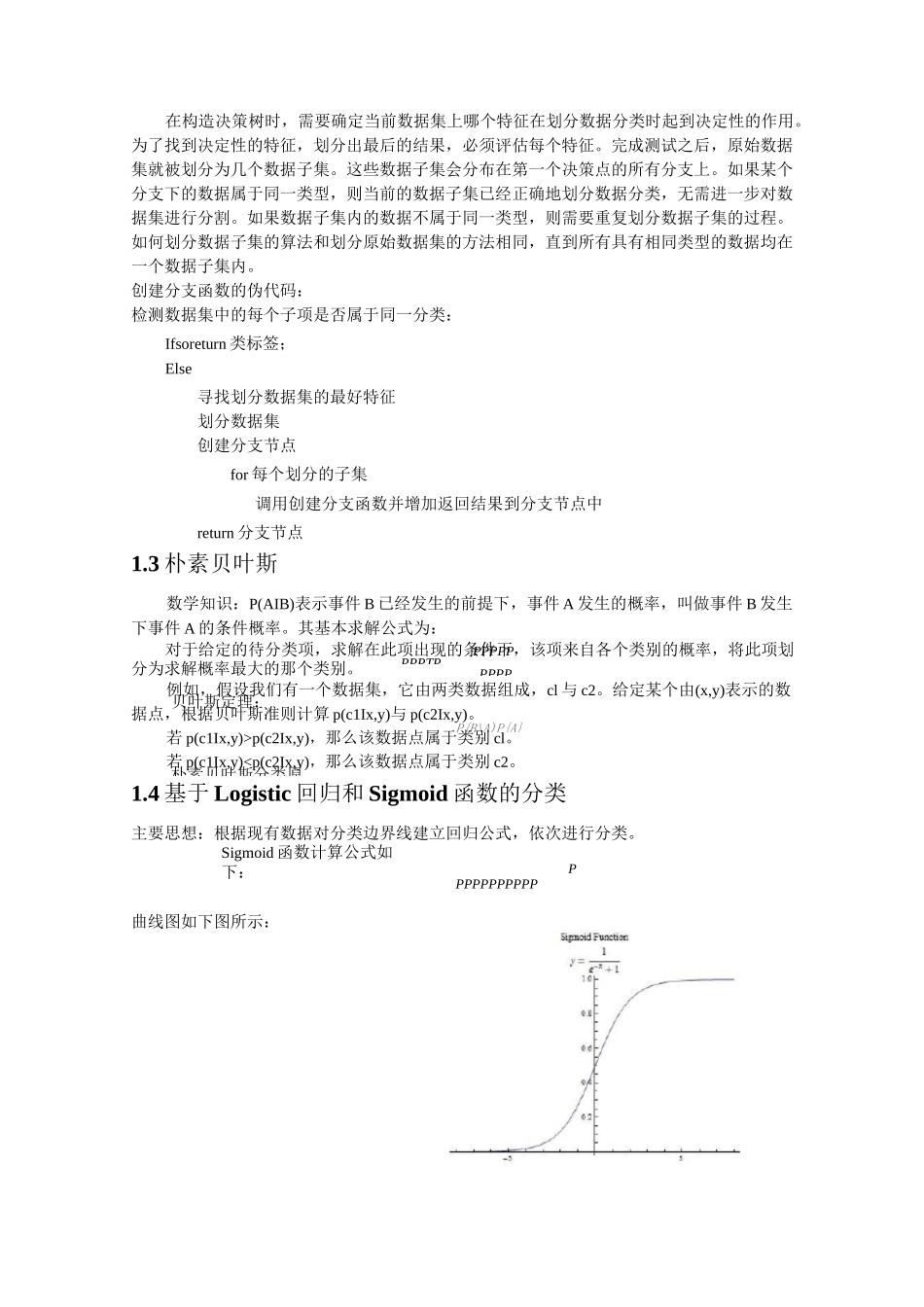

PPPTPPPPPPPPPP贝叶斯定理:朴素贝叶斯分类原P{B\A)P{A}在构造决策树时,需要确定当前数据集上哪个特征在划分数据分类时起到决定性的作用

为了找到决定性的特征,划分出最后的结果,必须评估每个特征

完成测试之后,原始数据集就被划分为几个数据