实验三、 SVM 用于模式识别一、实验目的1

理解 SVM 的基本原理;2

讨论 SVM 的分类效果;3

了解混淆均值的应用,熟悉 MATLAB 工具箱

二、实验原理支持向量机在统计学习理论的基础上进展了一种新的机器学习方法

假如仅从分类的角度来说,它是一种广义的线性分类器,它是在线性分类器的基础上,通过引入结构风险最小化原则、最优化理论和核函数演化而成的

该方法根据有限的样本信息在模型的复杂性和学习能力之间寻求最佳折中,以期获得最好的推广能力

而且,只要定义不同的核函数,就可以实现其它现有的学习算法

因此,支持向量机己经在众多领域取得了成功的应用

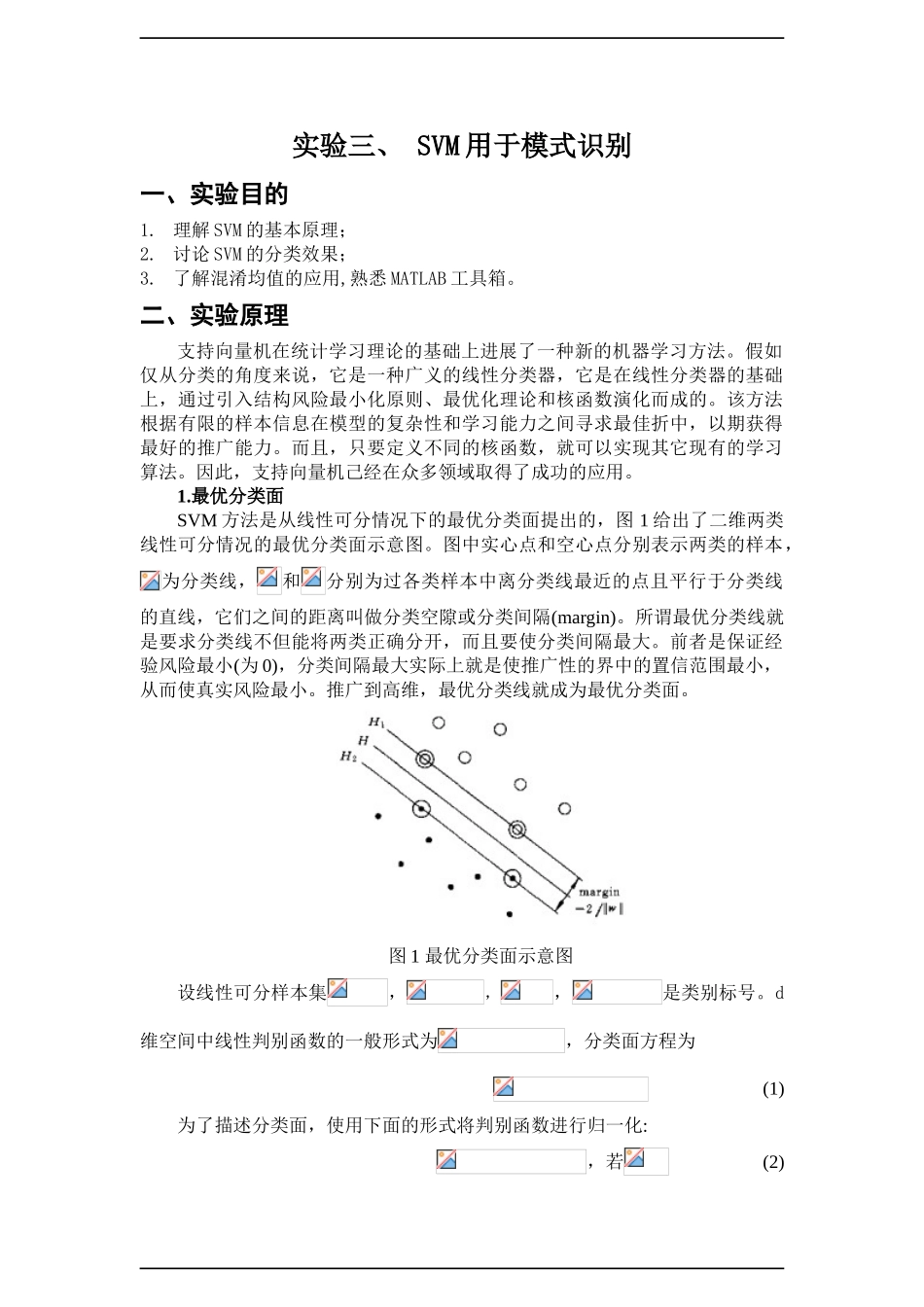

最优分类面SVM 方法是从线性可分情况下的最优分类面提出的,图 1 给出了二维两类线性可分情况的最优分类面示意图

图中实心点和空心点分别表示两类的样本,为分类线,和分别为过各类样本中离分类线最近的点且平行于分类线的直线,它们之间的距离叫做分类空隙或分类间隔(margin)

所谓最优分类线就是要求分类线不但能将两类正确分开,而且要使分类间隔最大

前者是保证经验风险最小(为 0),分类间隔最大实际上就是使推广性的界中的置信范围最小,从而使真实风险最小

推广到高维,最优分类线就成为最优分类面

图 1 最优分类面示意图设线性可分样本集,,,是类别标号

d维空间中线性判别函数的一般形式为,分类面方程为 (1)为了描述分类面,使用下面的形式将判别函数进行归一化:,若 (2),若 (3)即使两类所有样本都满足离分类面最近的样本的,这样分类间隔就等于,因此使间隔最大等价于使 (或)最小;而要求分类线对所有样本正确分类,就是要求它满足:, (4)因此满足条件式(3 一 13)且使最小的分类面就是最优分类面

过两类样本中离分类面最近的点且平行于最优分类面的超平面、上的训练样本就是式(4)中使等号成立的那些样本,称之为支持向量(Suppor