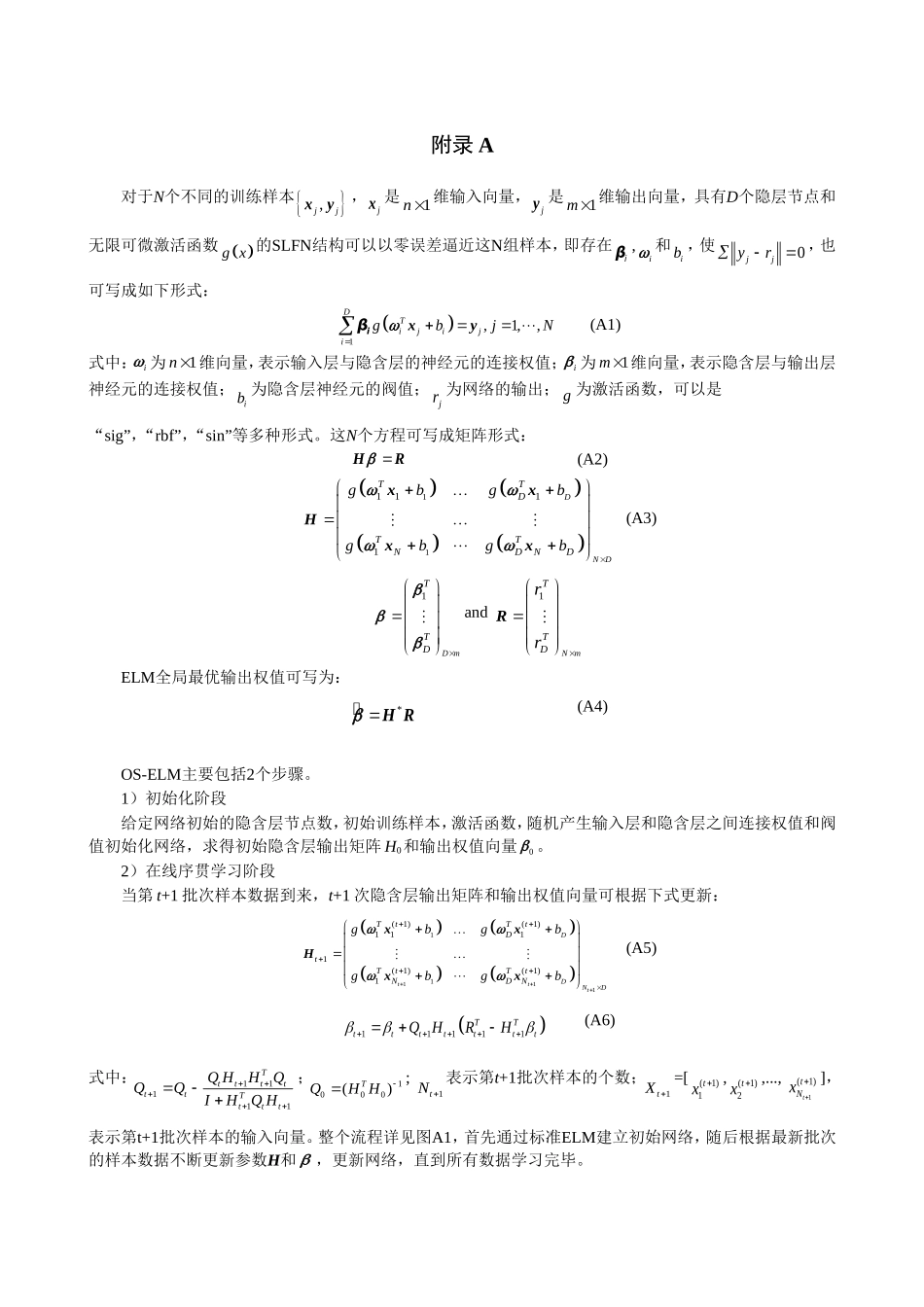

附录A对于N个不同的训练样本,jjxy,jx是1n维输入向量,jy是1m维输出向量,具有D个隐层节点和无限可微激活函数gx的SLFN结构可以以零误差逼近这N组样本,即存在βi,i和ib,使0jjyr,也可写成如下形式:1,1,,DTijijigbjNiβxy(A1)式中:i为1n维向量,表示输入层与隐含层的神经元的连接权值;i为1m维向量,表示隐含层与输出层神经元的连接权值;ib为隐含层神经元的阀值;jr为网络的输出;g为激活函数,可以是“sig”,“rbf”,“sin”等多种形式

这N个方程可写成矩阵形式:HR(A2)111111DNDTTDTTNDNDgbgbgbgbxxHxx(A3)1DmTTDand1NmTTDrrRELM全局最优输出权值可写为:*HR(A4)OS-ELM主要包括2个步骤

1)初始化阶段给定网络初始的隐含层节点数,初始训练样本,激活函数,随机产生输入层和隐含层之间连接权值和阀值初始化网络,求得初始隐含层输出矩阵H0和输出权值向量0

2)在线序贯学习阶段当第t+1批次样本数据到来,t+1次隐含层输出矩阵和输出权值向量可根据下式更新:11111(1)(1)1111(1)(1)1tttDDNDTtTtDtTtTtNDNgbgbgbgbxxHxx(A5)11111TTtttttttQHRH(A6)式中:11111TttttttTtttQHHQQQIHQH;1000()TQHH;1tN表示第t+1批次样本的个数;1tX=[(1)1tx,(1)2tx