2BP神经期络结构示育图2-5

4BP神经网络的基本原理BP(BackPropagation)网络是1986年由Rinehart和McClelland为首的科学家小组提出,是一种按误差逆传播算法训练的多层前馈网络,是目前应用最广泛的神经网络模型之一

BP网络能学习和存贮大量的输入-输出模式映射关系,而无需事前揭示描述这种映射关系的数学方程

它的学习规则是使用最速下降法,通过反向传播来不断调整网络的权值和阈值,使网络的误差平方和最小

BP神经网络模型拓扑结构包括输入层(input)、隐层(hidelayer)和输出层(outputlayer)(如图5

1BP神经元图5

3给出了第j个基本BP神经元(节点),它只模仿了生物神经元所具有的三个最基本也是最重要的功能:加权、求和与转移

其中x、x…乂…乂分别代表来自神经元1、2・・・i・・・n12in的输入;w、w•…•…则分别表示神经元1、2—i—n与第j个神经元的连接强度,即权j1j2jijn值;b为阈值;f(・)为传递函数;y为第j个神经元的输出

jj第j个神经元的净输入值6为:(5

12)隐输出ffl5

3BP神经元其中:忑“眄也…码…兀』若视心二-叫二气,即令図及眄包括坯及叽则(5

13于是节点j的净输入6可表示为:2-0净输入①通过传递函数(TransferFunction)f(■)后,便得到第j个神经元的输出儿:(5

14)式中f(・)是单调上升函数,而且必须是有界函数,因为细胞传递的信号不可能无限增加,必有一最大值

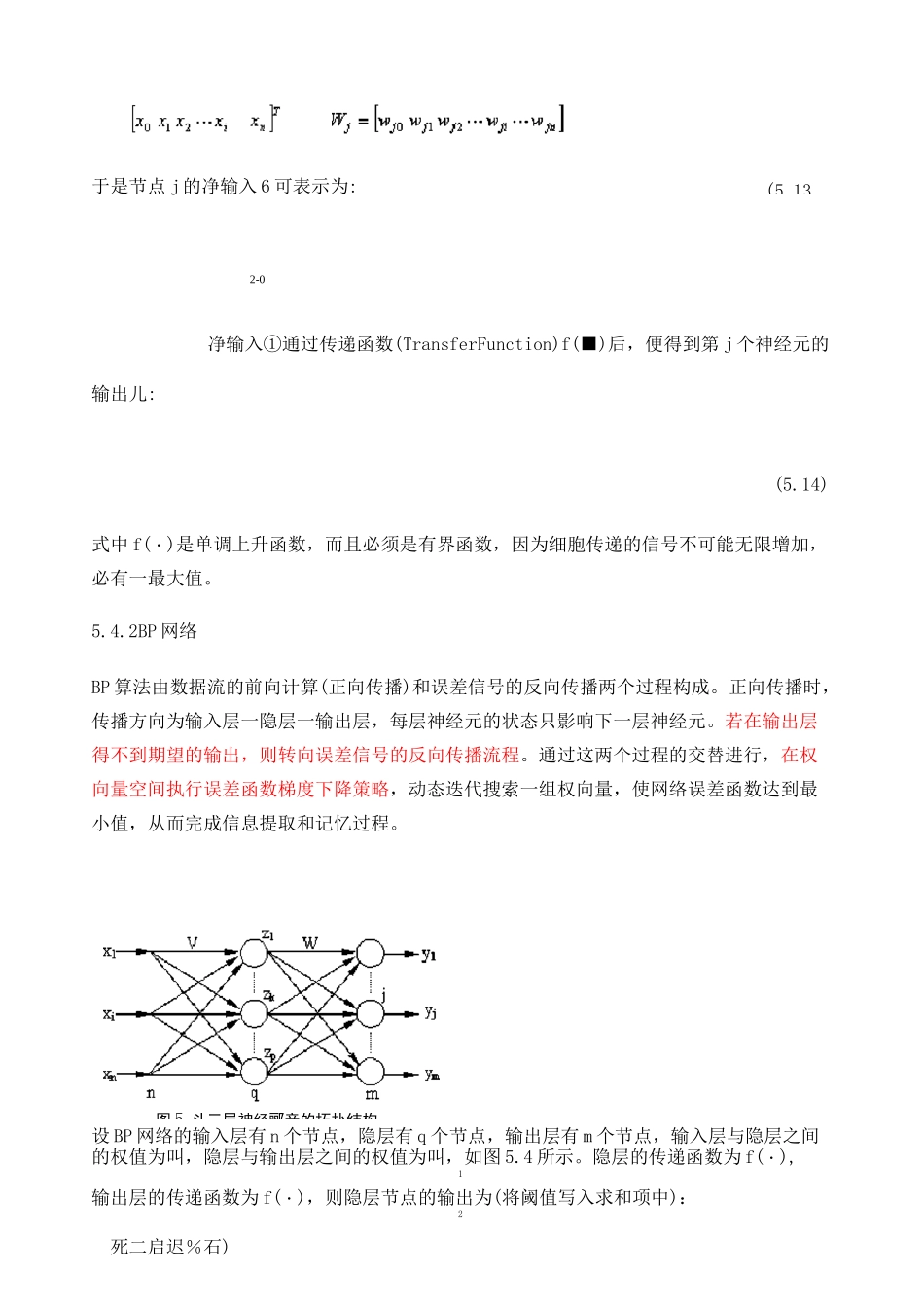

2BP网络BP算法由数据流的前向计算(正向传播)和误差信号的反向传播两个过程构成

正向传播时,传播方向为输入层一隐层一输出层,每层神经元的状态只影响下一层神经元

若在输出层得不到期望的输出,则转向误差信号的反向传播流程

通过这两个过程的交替进行,在权向量空间执行误差函数梯度