Adaboost算法 1、Adaboost算法简介 Adaboost算法是Freund和Schapire根据在线分配算法提出的,他们详细分析了Adaboost算法错误率的上界,以及为了使强分类器达到错误率,算法所需要的最多迭代次数等相关问题

与Boosting算法不同的是,Adaboost算法不需要预先知道弱学习算法学习正确率的下限即弱分类器的误差,并且最后得到的强分类器的分类精度依赖于所有弱分类器的分类精度,这样可以深入挖掘弱分类器算法的能力

2、Adaboost 算法基本原理 Adaboost是一种迭代算法,其核心思想是针对同一个训练集训练不同的分类器(弱分类器),然后把这些弱分类器集合起来,构成一个更强的最终分类器(强分类器)

其算法本身是通过改变数据分布来实现的,它根据每次训练集之中每个样本的分类是否正确,以及上次的总体分类的准确率,来确定每个样本的权值

将修改过权值的新数据集送给下层分类器进行训练,最后将每次训练得到的分类器最后融合起来,作为最后的决策分类器

使用Adaboost分类器可以排除一些不必要的训练数据特征,并将关键放在关键的训练数据上面

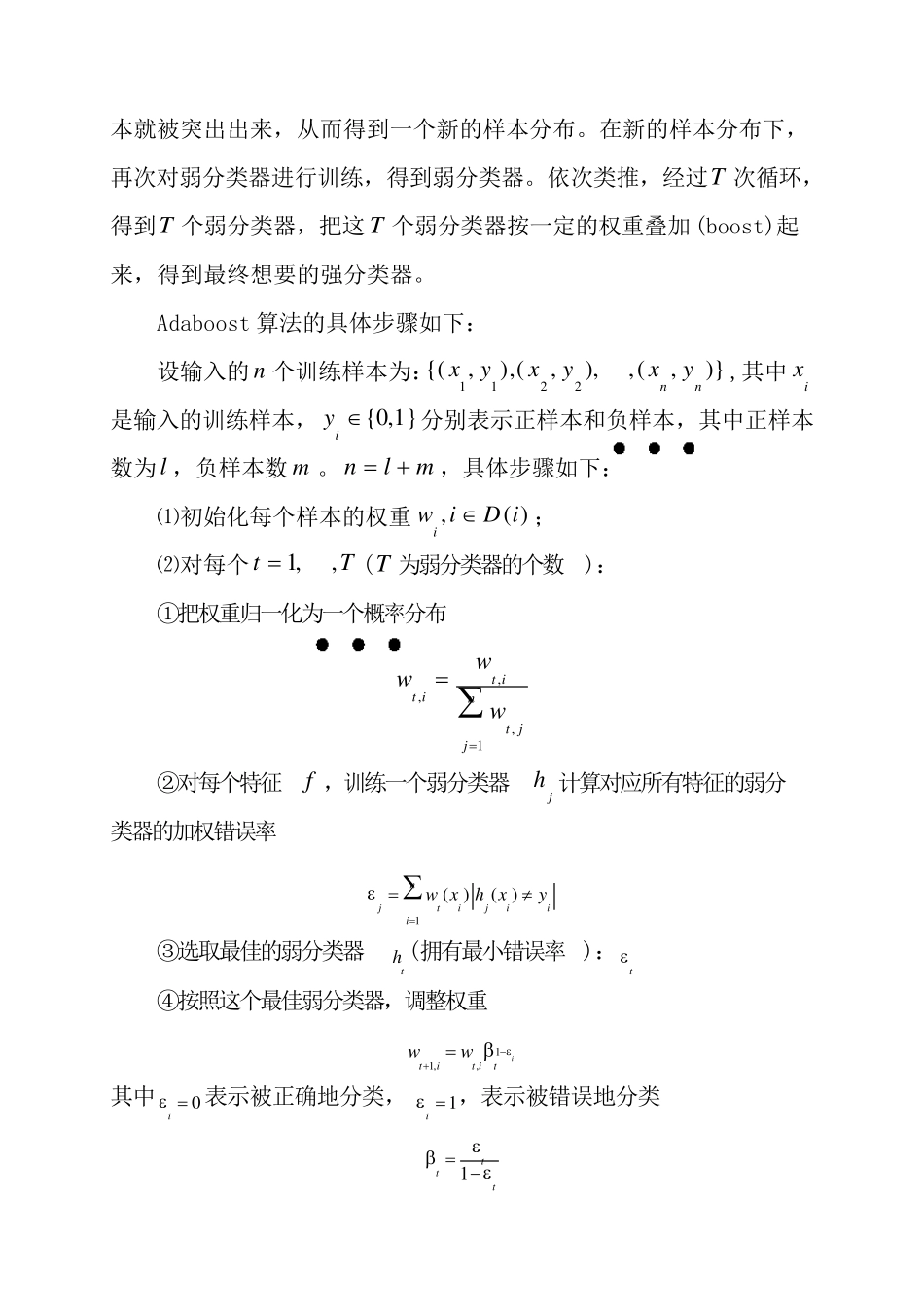

Adaboost算法中不同的训练集是通过调整每个样本对应的权重来实现的

开始时 ,每个样本对应的权重是相同的,即其中 n 为样本个数,在此 样本分布下训练出一弱分类器

对于分类错误的样本,加 大其对应的权重; 而 对于分类正确的样本,降 低 其权重,这样分错的样本就被突出出来,从而得到一个新的样本分布

在新的样本分布下,再次对弱分类器进行训练,得到弱分类器

依次类推,经过T 次循环,得到T 个弱分类器,把这T 个弱分类器按一定的权重叠加(boost)起来,得到最终想要的强分类器

Adaboost 算法的具体步骤如下: 设输入的n 个训练样本为:1122{(,),(,),,(,)}nnx yx yx y,其中ix是