大数据基础课程设计报告 一、项目简介: 使用 hadoop 中的 hive、mapreduce 以及 HBASE 对网上的一个搜狗五百万的数进行了一个比较实际的数据分析

搜狗五百万数据,是经过处理后的搜狗搜索引擎生产数据,具有真实性,大数据性,能够较好的满足分布式计算应用开发课程设计的数据要求

搜狗数据的数据格式为:访问时间\t 用户 ID\t[查询词]\t 该 URL 在返回结果中的排名\t 用户点击的顺序号\t 用户点击的 URL

其中,用户 ID 是根据用户使用浏览器访问搜索引擎时的 Cookie 信息自动赋值,即同一次使用浏览器输入的不同查询对应同一个用户 ID

二、操作要求 1

将原始数据加载到 HDFS 平台

将原始数据中的时间字段拆分并拼接,添加年、月、日、小时字段

将处理后的数据加载到 HDFS 平台

以下操作分别通过 MR 和 Hive 实现

查询总条数 非空查询条数 无重复总条数 独立UID 总数 查询频度排名(频度最高的前50 词) 查询次数大于2 次的用户总数 查询次数大于2 次的用户占比 Rank 在10 以内的点击次数占比 直接输入URL 查询的比例 查询搜索过”仙剑奇侠传“的uid,并且次数大于3 5

将 4 每步骤生成的结果保存到 HDFS 中

将 5 生成的文件通过Java API 方式导入到 HBase(一张表)

通过HBase shell 命令查询6 导出的结果

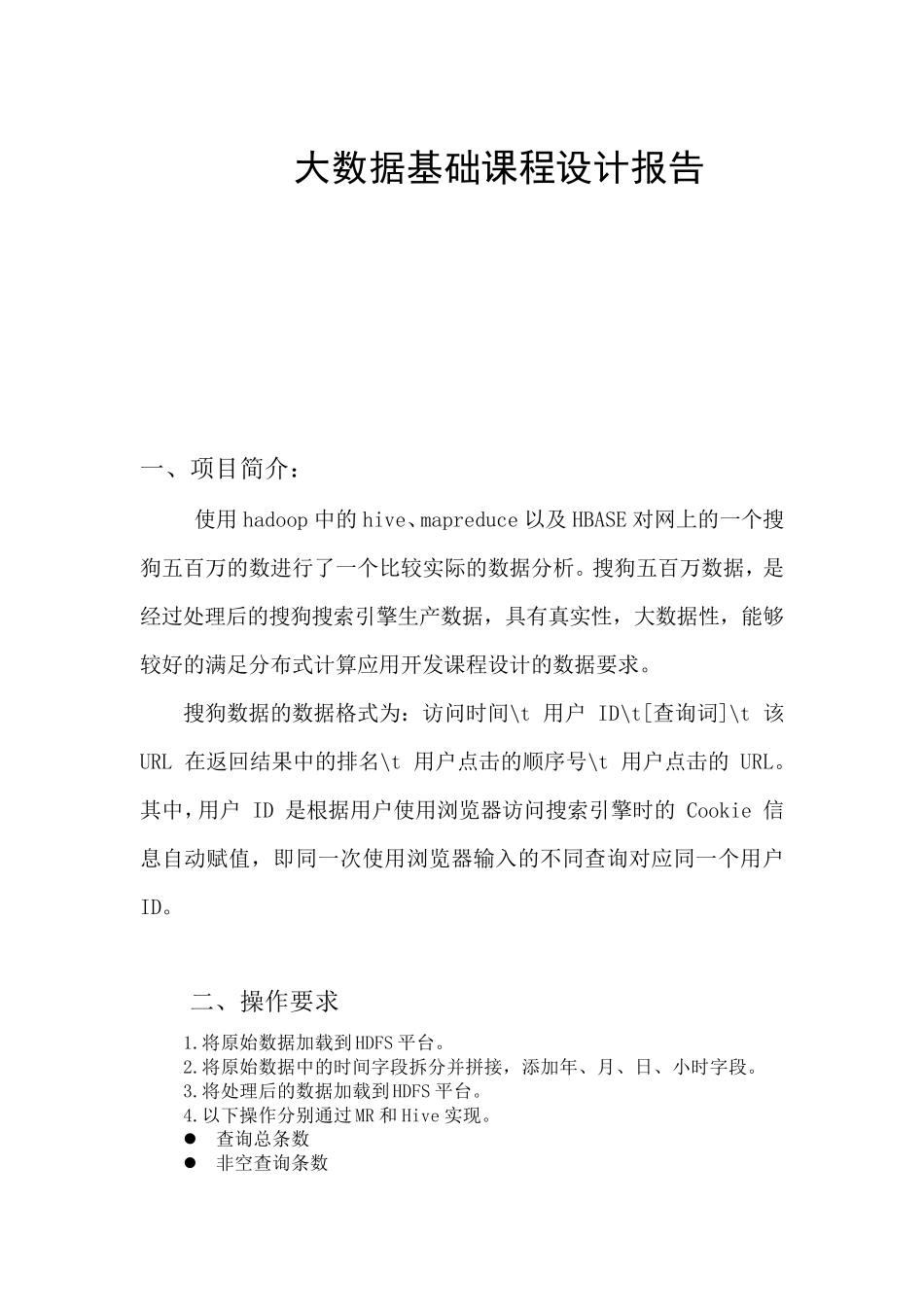

三、实验流程 1

将原始数据加载到HDFS 平台 2

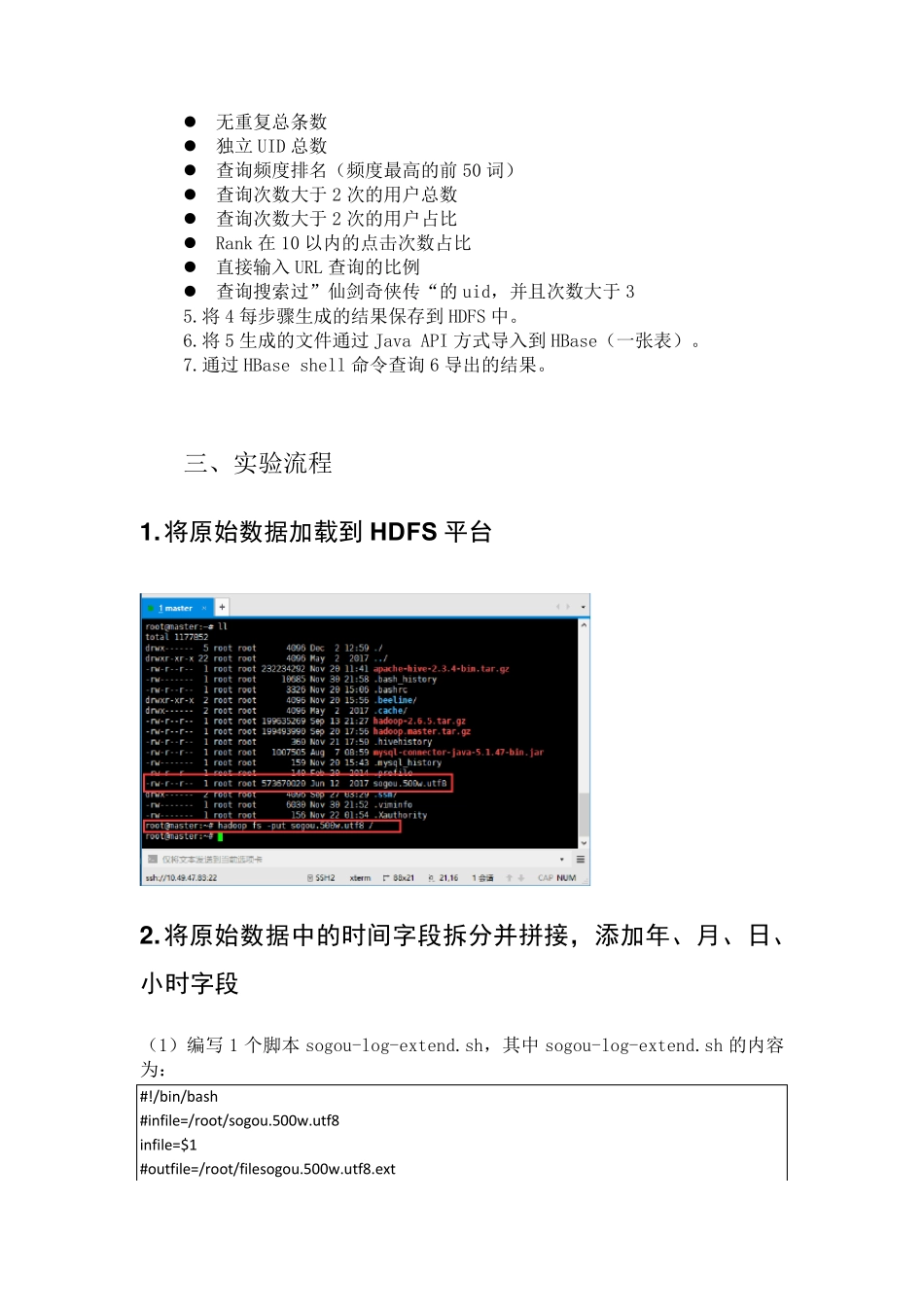

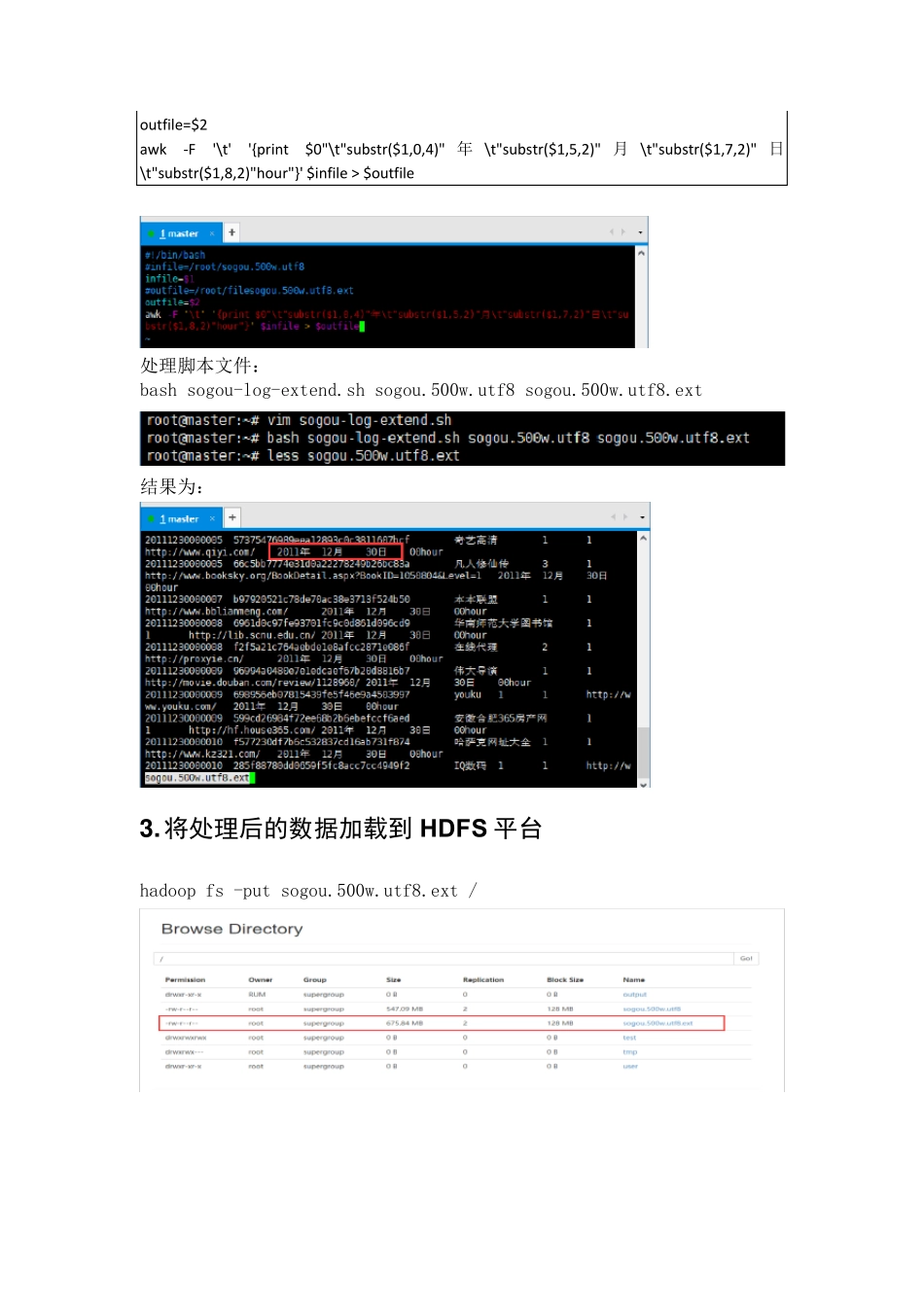

将原始数据中的时间字段拆分并拼接,添加年、月、日、小时字段 (1)编写 1 个脚本 sogou-log-extend

sh,其中 sogou-log-extend

sh 的内容为: #

/bin/bash #infile=/root/sog