下载后可任意编辑基于 Hadoop 分布式爬虫设计综述摘要:由于 Internet 规模不断扩大,包罗万象的信息资源被连接在一起,形成了一个宽阔宏大的信息空间"在这个空间中,存在着海量的信息,如何快速高效和安全地让网络用户在如此浩瀚的信息海洋之中找到并猎取自己所需的资源,是当前互联网进展的最大挑战之一

如今,云计算已成为当前的重要趋势之一

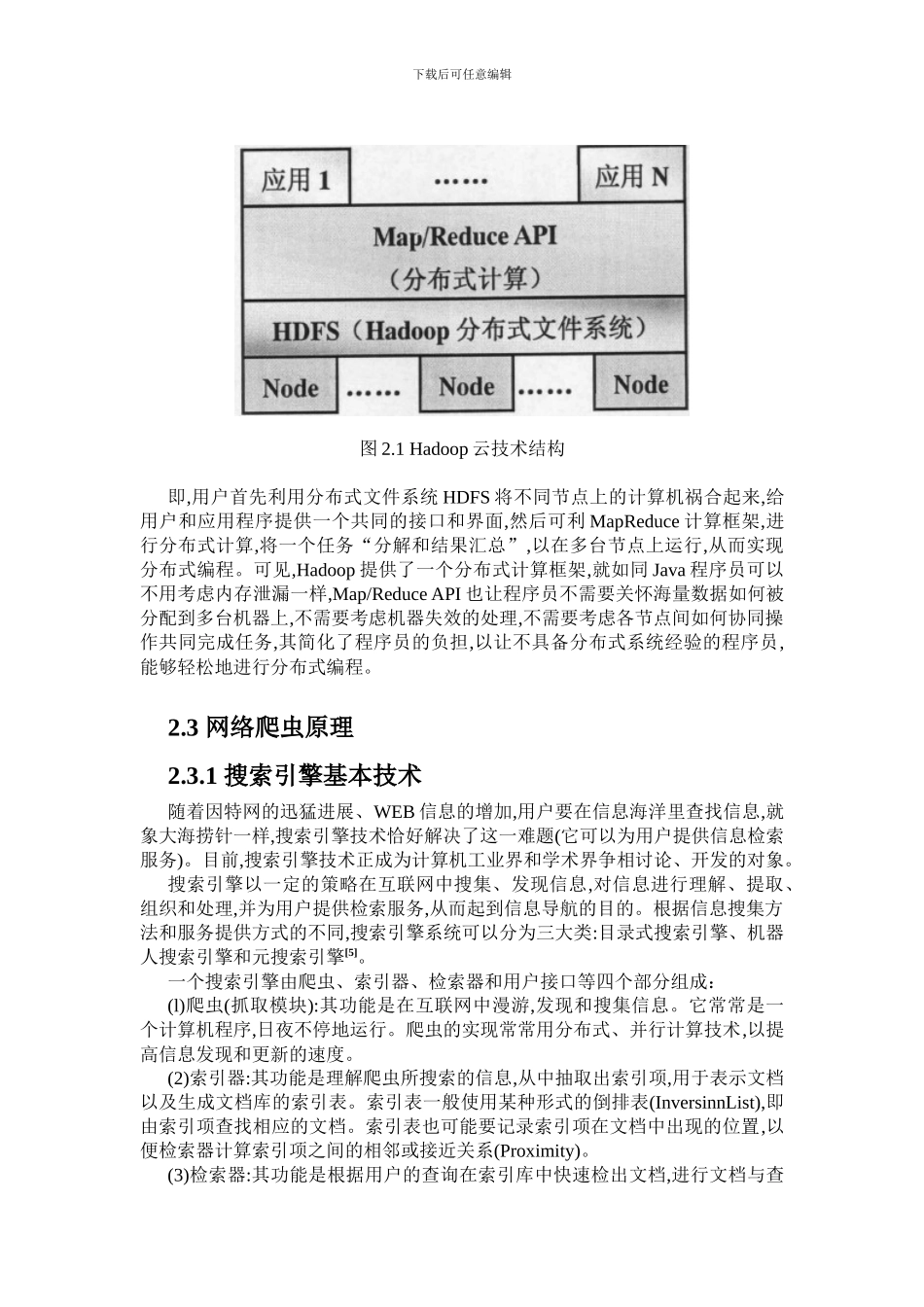

本文主要阐述在 Hadoop 分布式文件系统 HDFS 以及分布式计算框架 MapReduce 的基础上开发的分布式搜索引擎的爬虫设计相关技术、原理、流程图

关键词:云计算 分布式爬虫 Hadoop 搜索引擎1 引言随着搜索引擎的进展,搜索引擎所采纳的技术也随之变得丰富和多样化,能够适应不同搜索用户以及不同搜索目的的需要

目前,搜索引擎的性能指标主要有三个:首先考虑的是规模的大小,只有规模达到一定的数量级,用户搜索结果的符合度才能够达到满足不同用户的需求程度;其次是性能,搜索引擎的网络蜘蛛必须在一个较短的时间内完成对目标网络的信息搜索,同时,能够在用户可容忍的时间段内,完成搜索结果的反馈;最后是搜索的质量,能够去掉信息重复的网页,对一些无用信息进行过滤,能够准确返回用户想要的结果

如何从庞大的资料库中找到正确的资料,被公认为是下一代搜索技术的竞争要点"要对海量的信息进行检索,单单依靠单台计算机的处理能力远远不够,即使硬件的进展速度很快,但是根本赶不上信息的增长速度

而若采纳集群计算机实现,虽然可以解决处理速度问题,但由于从网络的整体上看,该集群仍是一个结点,会严重受制于网络带宽,因此,需要采纳多台计算机进行分布式协同处理"

分布式搜索引擎是通过网络把大范围的分布、异构数据集联合起来,形成一个逻辑整体,为用户提供分布式的信息检索服务

同传统搜索引擎相比,分布式搜索引擎有以下优点:1)各检索服务器之间协同工作,每个服务器只搜索自身自治区域内的