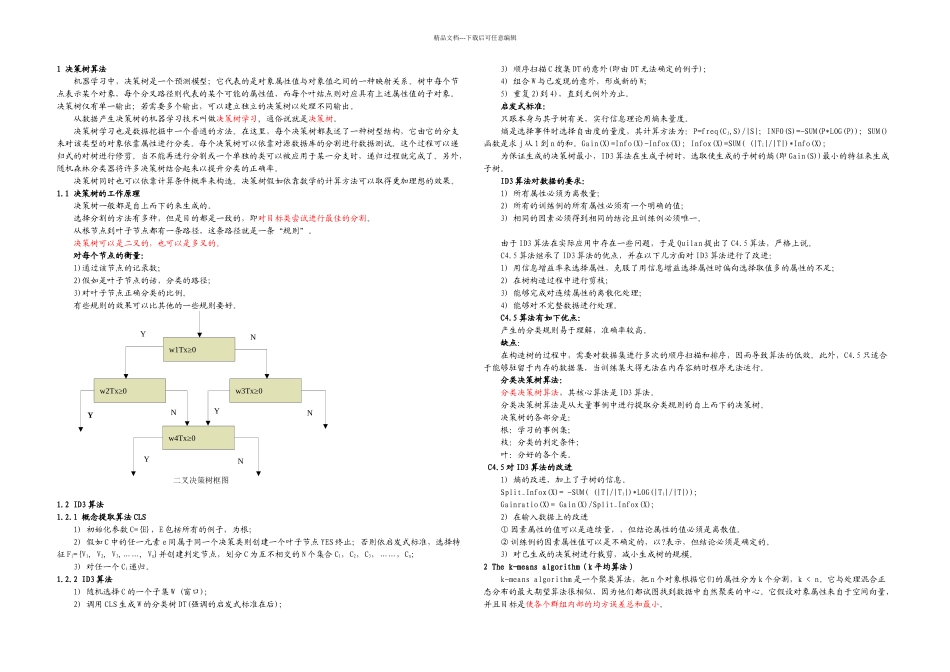

YYYYNNNNw1Tx≥0 w4Tx≥0 w3Tx≥0 w2Tx≥0 二叉决策树框图精品文档---下载后可任意编辑1 决策树算法机器学习中,决策树是一个预测模型;它代表的是对象属性值与对象值之间的一种映射关系

树中每个节点表示某个对象,每个分叉路径则代表的某个可能的属性值,而每个叶结点则对应具有上述属性值的子对象

决策树仅有单一输出;若需要多个输出,可以建立独立的决策树以处理不同输出

从数据产生决策树的机器学习技术叫做决策树学习, 通俗说就是决策树

决策树学习也是数据挖掘中一个普通的方法

在这里,每个决策树都表述了一种树型结构,它由它的分支来对该类型的对象依靠属性进行分类

每个决策树可以依靠对源数据库的分割进行数据测试

这个过程可以递归式的对树进行修剪

当不能再进行分割或一个单独的类可以被应用于某一分支时,递归过程就完成了

另外,随机森林分类器将许多决策树结合起来以提升分类的正确率

决策树同时也可以依靠计算条件概率来构造

决策树假如依靠数学的计算方法可以取得更加理想的效果

1 决策树的工作原理决策树一般都是自上而下的来生成的

选择分割的方法有多种,但是目的都是一致的,即对目标类尝试进行最佳的分割

从根节点到叶子节点都有一条路径,这条路径就是一条“规则”

决策树可以是二叉的,也可以是多叉的

对每个节点的衡量:1)通过该节点的记录数;2)假如是叶子节点的话,分类的路径;3)对叶子节点正确分类的比例

有些规则的效果可以比其他的一些规则要好

2 ID3 算法 1

1 概念提取算法 CLS 1) 初始化参数 C={E},E 包括所有的例子,为根;2) 假如 C 中的任一元素 e 同属于同一个决策类则创建一个叶子节点 YES 终止;否则依启发式标准,选择特征 Fi={V1, V2, V3,……, Vn}并创建判定节点,划分 C 为互不相交的 N 个集合 C1,C2,C3,