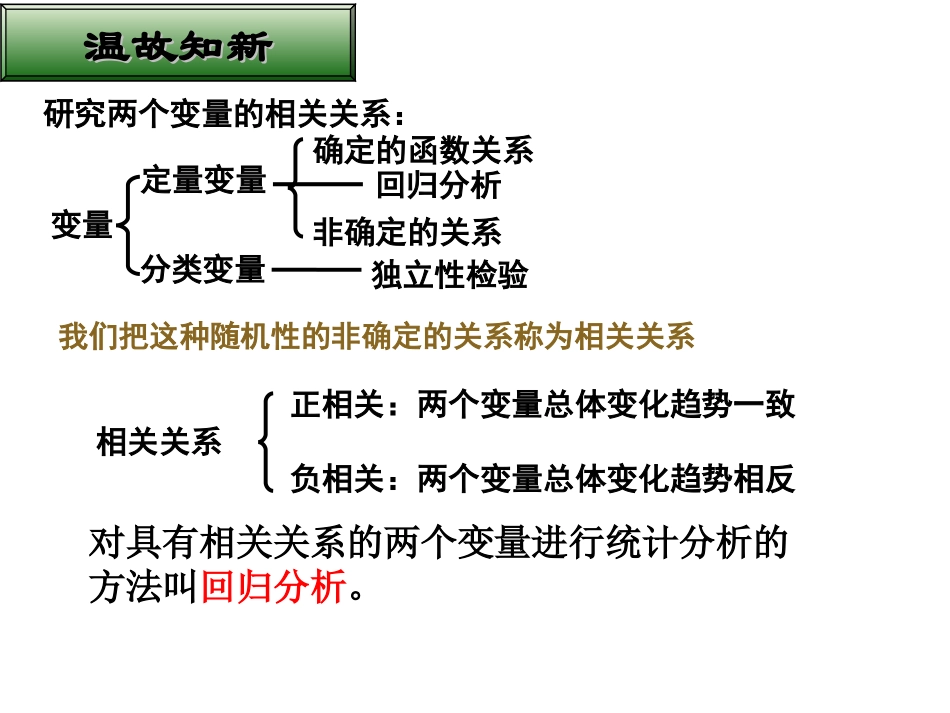

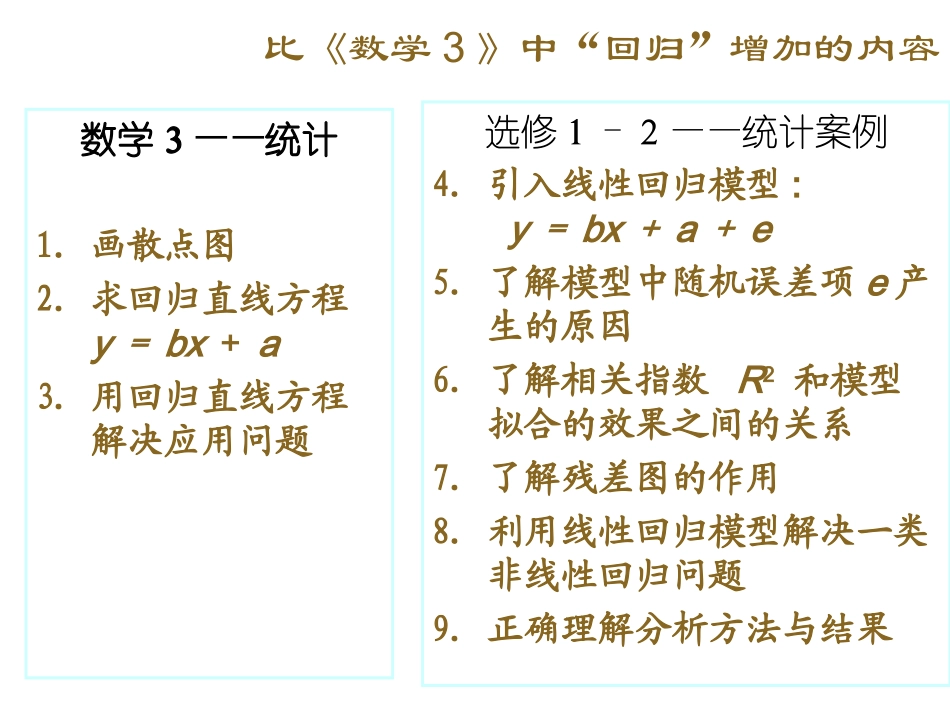

1.1回归分析的基本思想及其初步应用温故知新温故知新研究两个变量的相关关系:非确定的关系确定的函数关系我们把这种随机性的非确定的关系称为相关关系相关关系正相关:两个变量总体变化趋势一致负相关:两个变量总体变化趋势相反对具有相关关系的两个变量进行统计分析的方法叫回归分析。变量定量变量分类变量回归分析独立性检验比《数学3》中“回归”增加的内容数学3——统计1.画散点图2.求回归直线方程y=bx+a3.用回归直线方程解决应用问题选修1-2——统计案例4.引入线性回归模型:y=bx+a+e5.了解模型中随机误差项e产生的原因6.了解相关指数R2和模型拟合的效果之间的关系7.了解残差图的作用8.利用线性回归模型解决一类非线性回归问题9.正确理解分析方法与结果一、回归直线方程:ˆˆˆnniiiii=1i=1nn222iii=1i=1(x-x)(y-y)x-nxyb==,(x-x)x-nxa=y-bxy2.回归直线过样本点的中心1、用最小二乘法所求直线方程叫做回归直线方程;其中ˆˆˆy=bx+a(x,y)称为样本点的中心。(x,y)例1、某大学中随机选取8名女大学生,其身高和体重数据如下表所示.编号12345678身高/cm165165157170175165155170体重/kg4857505464614359求根据女大学生的身高(x)预报体重(y)的回归方程,并预报一名身高为172cm的女大学生的体重.根据最小二乘法估计和ab于是有nniiiii=1i=1nn222iii=1i=1(x-x)(y-y)xy-nxyb===0.849,(x-x)x-nxa=y-bx=-85.712相关系数•1.计算公式•2.相关系数的性质•(1)|r|≤1.r>0正相关;r<0负相关•(2)|r|越接近于1,相关程度越大;|r|越接近于0,相关程度越小.niii=1nn22iii=1i=1(x-x)(y-y)r=(x-x)(y-y)散点图:3、从散点图还看到,样本点散布在某一条直线的附近,而不是在一条直线上,所以不能用一次函数y=bx+a简单描述它们关系。我们可以用下面的线性回归模型来表示:y=bx+a+e,其中a和b为模型的未知参数,e称为随机误差。线性回归模型y=bx+a+e增加了随机误差项e,因变量y的值由自变量x和随机误差项e共同确定,即自变量x只能解析部分y的变化。在统计中,我们也把自变量x称为解释变量,因变量y为预报变量。思考:产生随机误差项e的原因是什么?随机误差e的来源(可以推广到一般):1、忽略了其它因素的影响:影响身高y的因素不只是体重x,可能还包括遗传基因、饮食习惯、生长环境等因素;2、用线性回归模型近似真实模型所引起的误差;3、身高y的观测误差。以上三项误差越小,说明我们的回归模型的拟合效果越好。残差数据点和它在回归直线上相应位置的差异称为相应于点(xi,yi)的残差。iiieyy=例:编号为6的女大学生,计算随机误差的效应(残差)61(0.84916585.712)6.627表1-4列出了女大学生身高和体重的原始数据以及相应的残差数据。残差分析与残差图的定义:我们可以通过残差来判断模型拟合的效果,判断原始数据中是否存在可疑数据,这方面的分析工作称为残差分析。12,,,neee编号12345678身高165165157170175165155170体重/kg4857505464614359残差-6.3732.6272.419-4.6181.1376.627-2.8830.382我们可以利用图形来分析残差特性,作图时纵坐标为残差,横坐标可以选为样本编号,或身高数据,或体重估计值等,这样作出的图形称为残差图。相关系数•1.计算公式•2.相关系数的性质•(1)|r|≤1.r>0正相关;r<0负相关•(2)|r|越接近于1,相关程度越大;|r|越接近于0,相关程度越小.niii=1nn22iii=1i=1(x-x)(y-y)r=(x-x)(y-y)我们可以用相关指数R2来刻画回归的效果,其计算公式是n2ii2i=1n2ii=1(y-y)R=1-(y-y)显然,R2的值越大,说明残差平方和越小,也就是说模型拟合效果越好。R2越接近1,表示回归的效果越好(因为R2越接近1,表示解析变量和预报变量的线性相关性越强)。如果某组数据可能采取几种不同回归方程进行回归分析,则可以通过比较R2的值来做出选择,即选取R2较大的模型作为这组数据的模型。用身高预报体重时,需要注意下列问题:1、回归方程只适用于我们所研究的样本的总体;2、我们所建立的回归方程一般都有时间性;3、样本采集的范围会影响回归方程的适用范围;4、不能期望...