�������������������2017

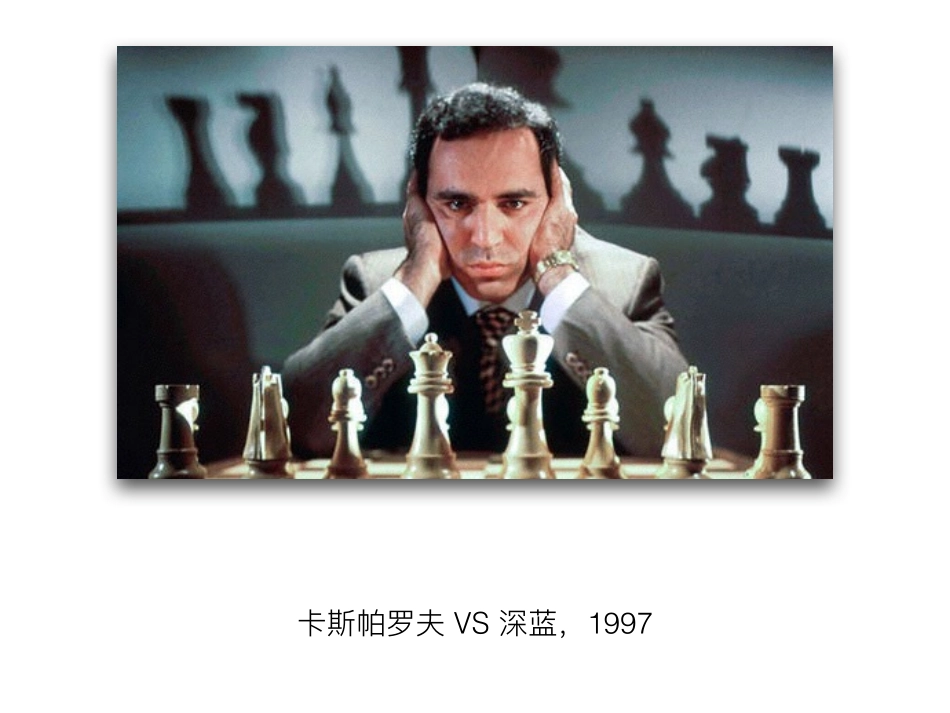

17�����VS���1997���VSAlphaGo�2016������������������������������������������������������������������1942�“�������”�����������������������������������������������������������������������������������������6�����������๏StuartRussel(美国加州大学伯克利分校计算机科学教授)๏SabineHauert(英国布里斯托尔大学机器人学讲师)๏RussAltman(美国斯坦福大学生物工程、基因学、医学和计算科学教授)๏ManuelaVeloso(美国卡内基·梅隆大学计算机学教授)๏用一句话概括文段的主要观点,并说说你为什么这样概括

8๏(1)人工智能(AI)和机器人领域的专家面临一个重要的伦理决策:必须要决定他们是支持还是反对致命自主武器系统(LAWS)

此类系统能在几年而非几十年内发展为可行的

该领域的风险很高,致命自主武器系统被描述为战争的第三次革命,前两次是火药和核武器

๏(2)在几年之内,军方就可以组装带有武器的四轴飞行器和微型坦克,这些自动的飞行器和坦克不需要人类干预,自己能决定谁能活下来而谁又会死去

例如,四轴飞行器能在一座城市中找到并打击敌方战士,但不包括人类能设定目标的巡航导弹和遥远的无人驾驶飞机

๏(3)但是,国际人道法律对于此类技术没有任何具体的规定,现在也还不清楚国际社会是否会支持一个限制或禁止此类武器系统的条约

1949年签订的战争人道主义《日内瓦公约》要求任何袭击需要满足3个条件:军事必需、参与战争者和非参战者差别对待、军事目标价值及其潜在附带伤害的平衡

而当前的自动武器很难或根本无法作出这