3 支持向量回归机 SVM 本身是针对经典的二分类问题提出的,支持向量回归机(Su pport Vector Regression,SVR)是支持向量在函数回归领域的应用

SVR 与SVM 分类有以下不同:SVM 回归的样本点只有一类,所寻求的最优超平面不是使两类样本点分得“最开”,而是使所有样本点离超平面的“总偏差”最小

这时样本点都在两条边界线之间,求最优回归超平面同样等价于求最大间隔

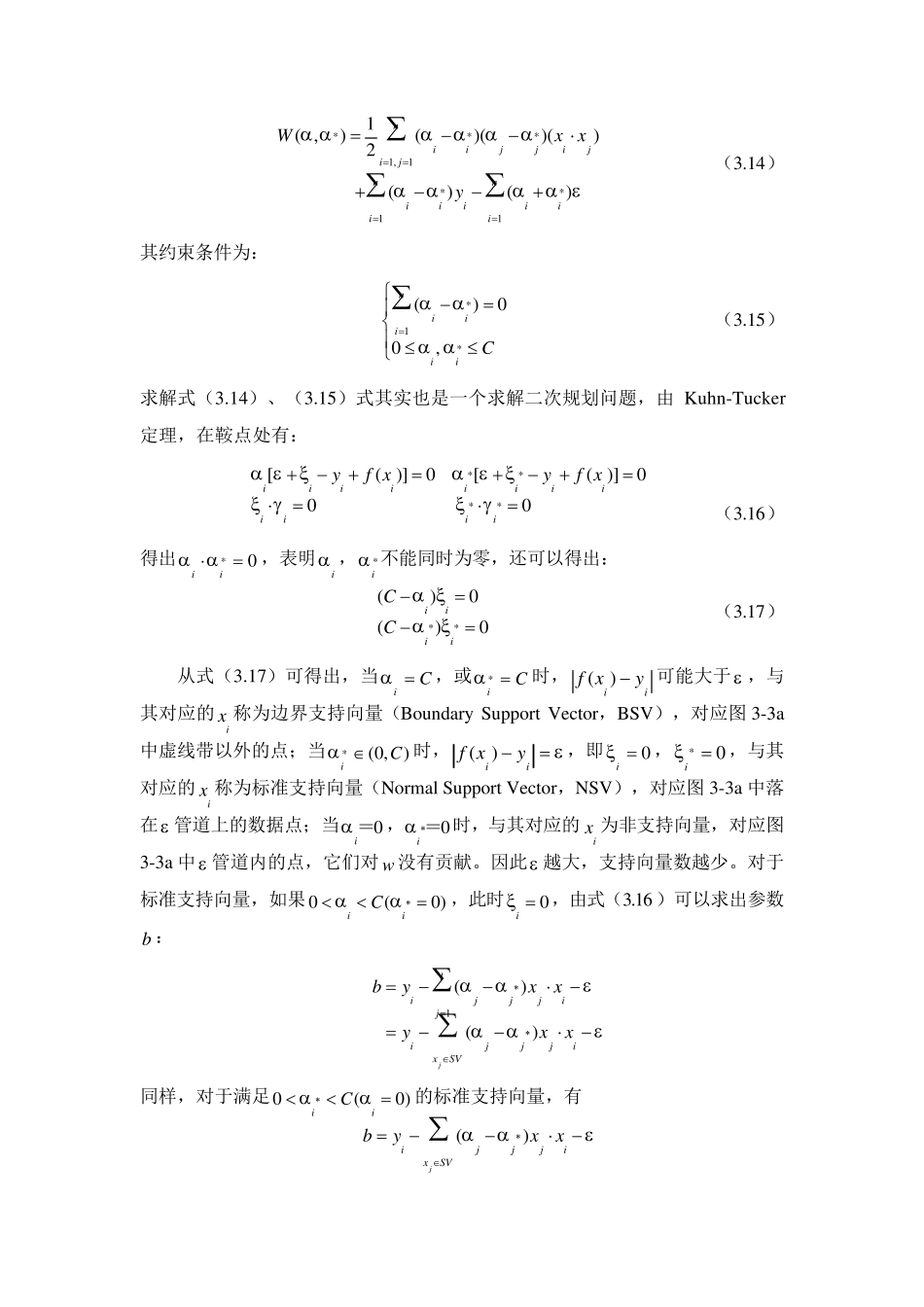

1 SVR 基本模型 对于 线 性 情 况 ,支持向量机函数拟 合 首 先 考 虑 用线 性 回归函数bxxf )(拟合niyxii,

,2,1),,(,niRx 为输入量,Ryi 为输出量,即需要确定 和b

图3-3a SVR 结构图 图3-3b 不灵敏度函数 惩罚函数是学习模型在学习过程中对误差的一种度量,一般在模型学习前己经选定,不同的学习问题对应的损失函数一般也不同,同一学习问题选取不同的损失函数得到的模型也不一样

常用的惩罚函数形式及密度函数如表 3-1

表 3-1 常用的损失函数和相应的密度函数 损失函数名称 损失函数表达式 ( )ic 噪声密度()ip -不敏感 i 1ex p()2(1)i 拉普拉斯 i 1 ex p()2i 高斯 212i 21ex p()22i 鲁棒损失 21 ( ) ,if;2,otherwise;2iii 2exp(),2exp(),2iiiifotherwise 多项式 1pip exp()2 (1/)pipp 分段多项式 11,1,piipiifppotherwisep 1exp(),1exp(),piipiifppotherwisep