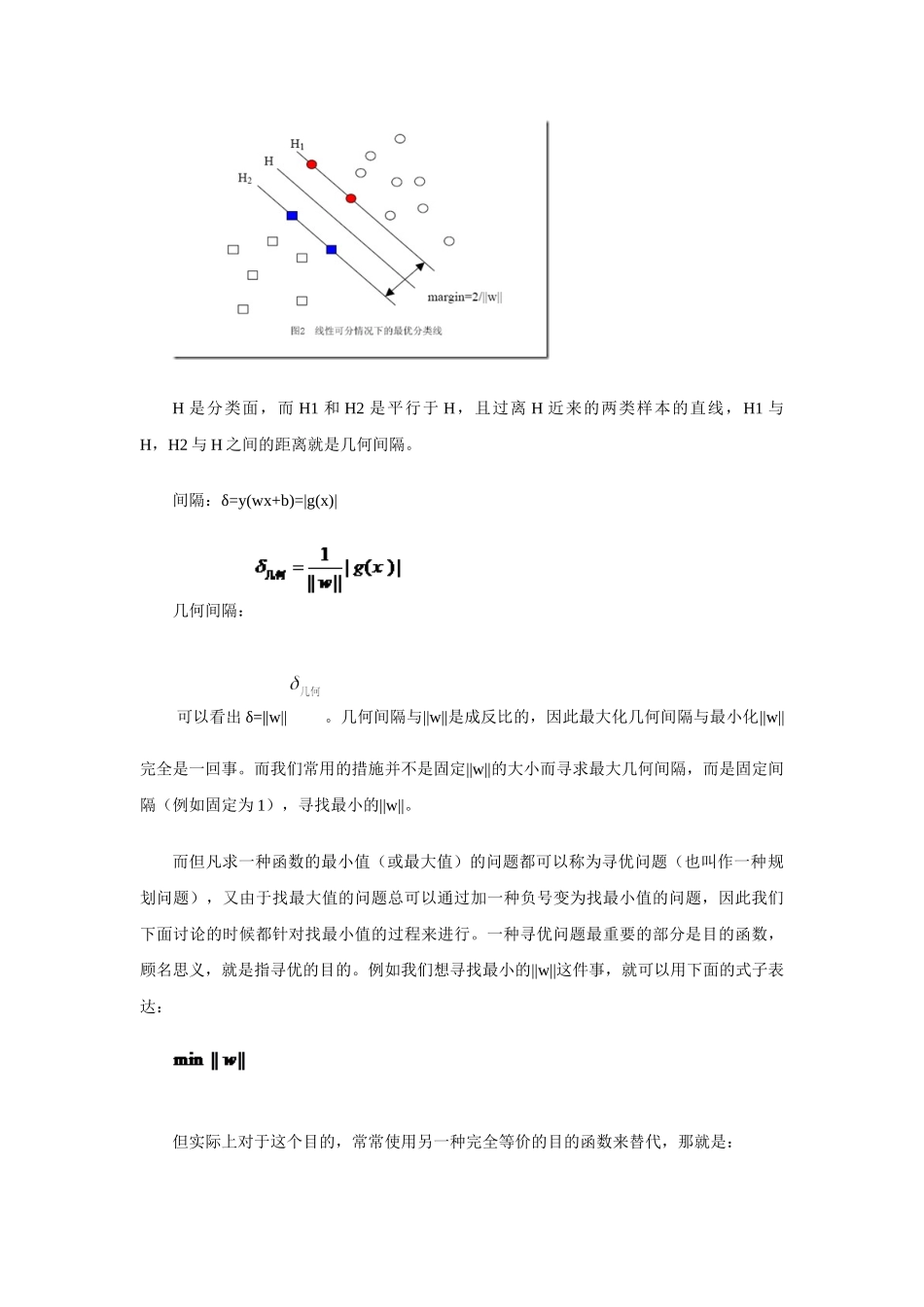

研究汇报题 目 支持向量机学习汇报 学 号 学 生 支持向量机学习汇报支持向量机措施是建立在记录学习理论的 VC 维理论和构造风险最小原理基础上的,根据有限的样本信息在模型的复杂性(即对特定训练样本的学习精度)和学习能力(即无错误地识别任意样本的能力)之间寻求最佳折衷,以期获得最佳的推广能力。支持向量机SVM(Support Vector Machine)是 AT&TBell 试验室的 V.Vapnik 提出的针对分类和回归问题的记录学习理论。由于 SVM 措施具有许多长处和有前途的试验性能,该技术已成为机器学习研究领域中的热点,并获得很理想的效果,如人脸识别、手写体数字识别和网页分类等。1 原理及措施SVM 根据问题的复杂性可以分为线性可分 SVM 和非线性可分 SVM,其基本原理如下:在进行文本分类的时候,每一种样本由一种向量(就是那些文本特征所构成的向量)和一种标识(标示出这个样本属于哪个类别)构成。如下: Di=(xi,yi) xi 就是文本向量(维数很高),yi 就是分类标识。 在二元的线性分类中,这个表达分类的标识只有两个值,1 和-1(用来表达属于还是不属于这个类)。有了这种表达法,可以定义一种样本点到某个超平面的间隔: yi(wxi+b)假如某个样本属于该类别的话,那么 wxi+b>0(由于我们所选的g(x)=wx+b 就通过不小于 0 还是不不小于 0 来判断分类),而 yi 也不小于 0;若不属于该类别的话,那么 wxi+b<0,而 yi 也不不小于 0,这意味着 yi(wxi+b)总是不小于 0 的,并且它的值就等于|wxi+b|(也就是|g(xi)|) 目前把 w 和 b 进行一下归一化,用 w/||w||和 b/||w||分别替代本来的 w 和 b,间隔就可以写成 当用归一化的 w 和 b 替代原值之后的间隔叫做几何间隔,几何间隔所示的正是点到超平面的欧氏距离,简称几何间隔为“距离”。同样一种点的集合(就是一组样本)到某个超平面的距离为此集合中离超平面近来的点的距离。下面这张图展示出了几何间隔的现实含义: H 是分类面,而 H1 和 H2 是平行于 H,且过离 H 近来的两类样本的直线,H1 与H,H2 与 H 之间的距离就是几何间隔。 间隔:δ=y(wx+b)=|g(x)| 几何间隔: 可以看出 δ=||w||。几何间隔与||w||是成反比的,因此最大化几何间隔与最小化||w||完全是一回事。而我们常用的措施并不是固定||w||的大小而寻求最大几何间隔,而是固定间隔(例如固定为 1),寻找最小的||w||。 而但凡求一种函数的最小值(或最大值...