流形学习简介许馨2004

9许馨2004

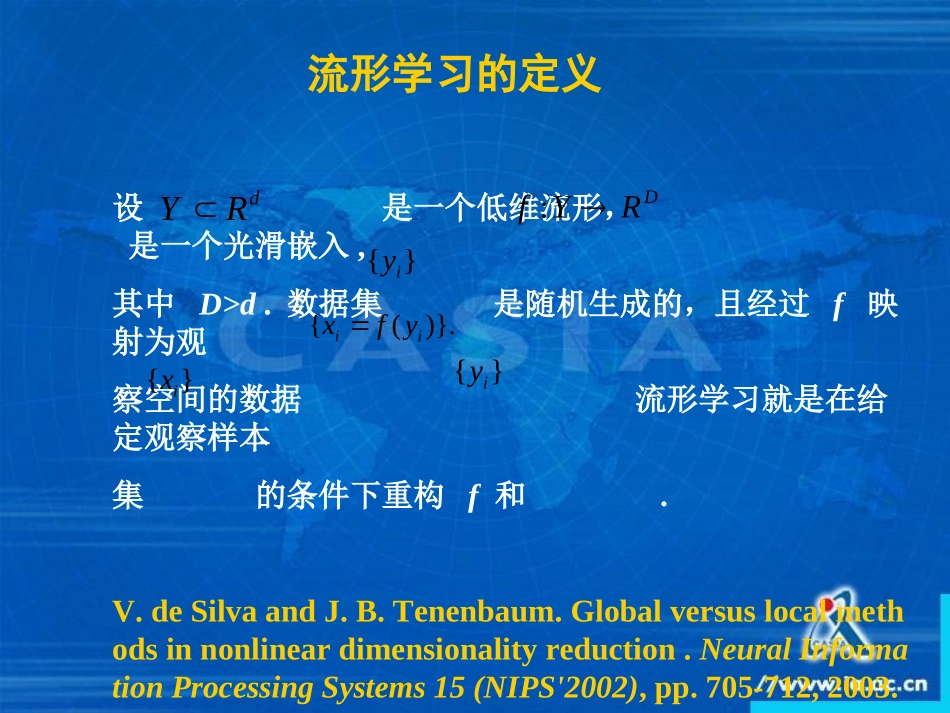

9设是一个低维流形,是一个光滑嵌入,其中D>d

数据集是随机生成的,且经过f映射为观察空间的数据流形学习就是在给定观察样本集的条件下重构f和

deSilvaandJ

Tenenbaum

Globalversuslocalmethodsinnonlineardimensionalityreduction

NeuralInformationProcessingSystems15(NIPS'2002),pp

705-712,2003

dRYDRYf:}{iy)}

({iiyfx}{ix}{iy流形学习的定义几种流形学习算法•局部线性嵌入(LLE)

RoweisandL

Nonlineardimensionalityreductionbylocallylinearembedding

Science,vol

290,pp

2323--2326,2000

•等距映射(Isomap)

Tenenbaum,V

deSilva,andJ

Langford

Aglobalgeometricframeworkfornonlineardimensionalityreduction

Science,vol

290,pp

2319--2323,2000

•拉普拉斯特征映射(LaplacianEigenmap)

Belkin,P

Niyogi,LaplacianEigenmapsforDimensionalityReductionandDataRepresentation

NeuralComputation,Vol

15,Issue6,pp

1373–1396,2003

基于流形学习的方法-LLE(locallylinearembedding)*1

LLE算法的主要思想:对于一组具有嵌套流形的数据集,