支持向量机(SVM)原理及应用一、SVM 得产生与进展自1995年Vapnik (瓦普尼克)在统计学习理论得基础上提出SVM作为模式识别得新方法之后,SVM一直倍受关注

同年,Vapnik与Cortes提出软间隔(soft margin)SVM,通过引进松弛变量度量数据得误分类(分类出现错误时大于0),同时在目标函数中增加一个重量用来惩处非零松弛变量(即代价函数),SVM得寻优过程即就是大得分隔间距与小得误差补偿之间得平衡过程;1996年,Vapnik等人又提出支持向量回归 (Support Vector Regression,SVR)得方法用于解决拟合问题

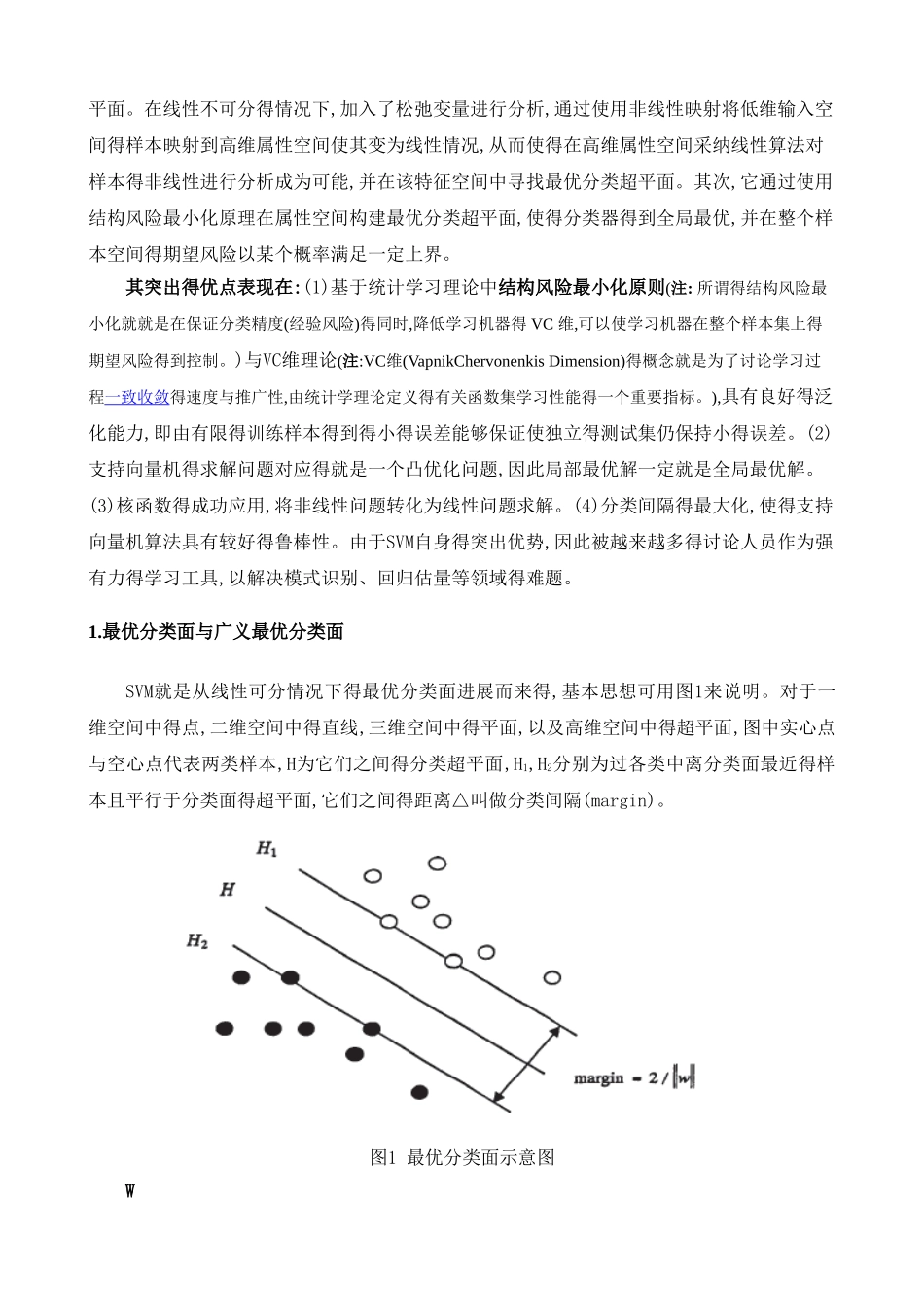

SVR同SVM得出发点都就是寻找最优超平面(注:一维空间为点;二维空间为线;三维空间为面;高维空间为超平面

),但SVR得目得不就是找到两种数据得分割平面,而就是找到能准确预测数据分布得平面,两者最终都转换为最优化问题得求解;1998年,Weston等人根 据 SVM 原 理 提 出 了 用 于 解 决 多 类 分 类 得 SVM 方 法 (MultiClass Support Vector Machines,MultiSVM),通过将多类分类转化成二类分类,将SVM应用于多分类问题得推断:此外,在SVM算法得基本框架下,讨论者针对不同得方面提出了很多相关得改进算法

例如,Suykens提 出 得 最 小 二 乘 支 持 向 量 机 (Least Square Support Vector Machine,LS—SVM) 算 法 ,Joachims等人提出得SVM1ight,张学工提出得中心支持向量机 (Central Support Vector Machine,CSVM),Scholkoph与Smola基于二次规划提出得vSVM等

此后,台湾大学林智仁(Lin ChihJen)教授等对SVM得典型应用进行总结,并设