其中m为训练集样本数,n为样本维度,y是样本的真实值

线性回归采用一个高维的线性函数来尽可能的拟合所有的数据点,最简单的想法就是最小化函数值与真实值误差的平方(概率解释-高斯分布加最大似然估计)

即有如下目标函数:T—皿

;-a』⑹(屉(門-严)i=i、niiiiJ(白|其中线性函数如下:如(工1"]=純+#1理+直云十务点构建好线性回归模型的目标函数之后,接下来就是求解目标函数的最优解,即一个优化问题

常用的梯度优化方法都可以拿来用,这里以梯度下降法来求解目标函数

”xyuT-

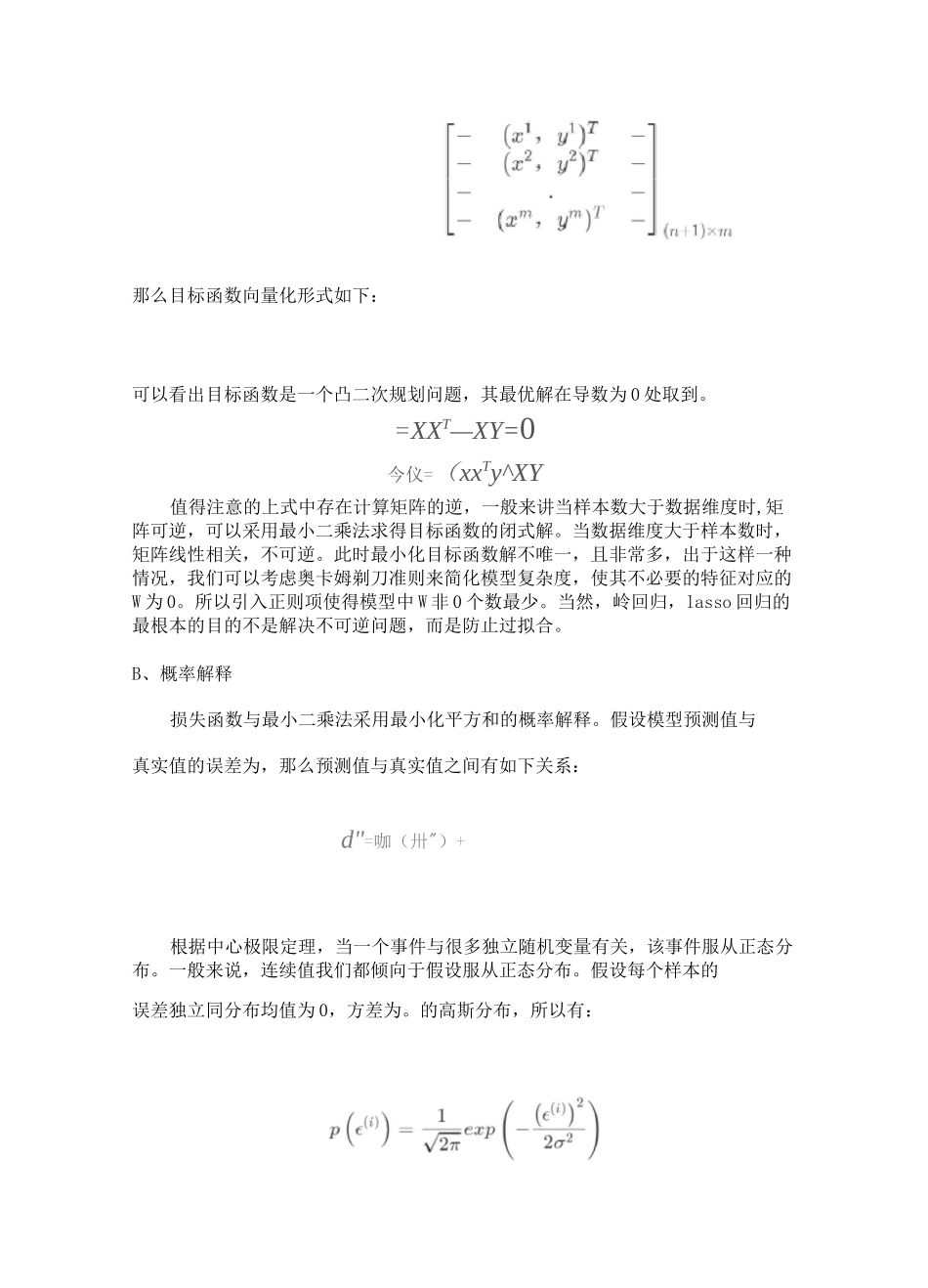

771,,构成如下数据矩阵

j=1A、线性回归假设有数据有:另外,线性回归也可以从最小二乘法的角度来看,下面先将样本表示向量化,那么目标函数向量化形式如下:可以看出目标函数是一个凸二次规划问题,其最优解在导数为0处取到

=XXT—XY=0今仪=(xxTy^XY值得注意的上式中存在计算矩阵的逆,一般来讲当样本数大于数据维度时,矩阵可逆,可以采用最小二乘法求得目标函数的闭式解

当数据维度大于样本数时,矩阵线性相关,不可逆

此时最小化目标函数解不唯一,且非常多,出于这样一种情况,我们可以考虑奥卡姆剃刀准则来简化模型复杂度,使其不必要的特征对应的W为0

所以引入正则项使得模型中W非0个数最少

当然,岭回归,lasso回归的最根本的目的不是解决不可逆问题,而是防止过拟合

B、概率解释损失函数与最小二乘法采用最小化平方和的概率解释

假设模型预测值与真实值的误差为,那么预测值与真实值之间有如下关系:d"=咖(卅")+根据中心极限定理,当一个事件与很多独立随机变量有关,该事件服从正态分布

一般来说,连续值我们都倾向于假设服从正态分布

假设每个样本的误差独立同分布均值为0,方差为

的高斯分布,所以有:即表示满足以均值为由最大似然估计岭回归和Lasso回归岭回归的目标函数在一般的线性回归的基础上加入了正则项,